Qu'est-ce que l'informatique en périphérie ?

L'edge computing est un modèle informatique décentralisé dans lequel le traitement des données s'effectue au point d'origine ou à proximité de celui-ci, plutôt que d'être transmis vers un centre de données centralisé ou un environnement cloud. Cette approche contraste avec les architectures informatiques traditionnelles qui reposent largement sur un traitement centralisé, souvent situé loin des appareils générant les données.

Dans un cadre d'informatique en périphérie, l'analyse des données et la réactivité du système s'effectuent beaucoup plus près du lieu où les données sont générées, qu'elles proviennent de systèmes IoT, de capteurs IoT en périphérie ou de systèmes de contrôle industriel. Cette approche locale de l'informatique permet aux systèmes de fonctionner avec une plus grande autonomie, ce qui leur permet d'interpréter les données et d'agir en conséquence sans dépendre d'une communication constante avec un cloud central ou un centre de données.

L'informatique en périphérie est étroitement liée au concept de « périphérie intelligente », dans lequel les appareils situés à la périphérie du réseau traitent et analysent les données en temps réel, permettant ainsi une prise de décision plus intelligente et plus rapide. Ces applications s'inscrivent souvent dans le cadre des applications de l'Internet des objets (IoT), conçues pour tirer parti de l'informatique décentralisée afin d'améliorer la réactivité.

L'essor de l'edge computing reflète le besoin croissant de gérer en temps réel l'afflux massif de données générées par des appareils décentralisés. À mesure que les environnements numériques gagnent en complexité et se dispersent géographiquement, les architectures centralisées traditionnelles peinent souvent à répondre aux exigences de performance et d'évolutivité. L'edge computing relève ce défi en répartissant la capacité de calcul sur différents points du réseau, ce qui permet d'obtenir des informations plus rapidement et d'assurer un comportement plus adaptatif du système.

Ce modèle décentralisé marque un tournant fondamental dans la manière dont les organisations développent et déploient les applications modernes. Plutôt que de concentrer toutes les tâches de traitement en un seul endroit, l'edge computing favorise les opérations décentralisées et permet la mise en place d'une infrastructure évolutive et résiliente dans tous les secteurs, de l'industrie manufacturière et de la logistique aux soins de santé et aux villes intelligentes – souvent en recourant à des systèmes intermédiaires tels que des passerelles IoT pour connecter les appareils en périphérie à des réseaux plus étendus.

Comment fonctionne l'Edge Computing

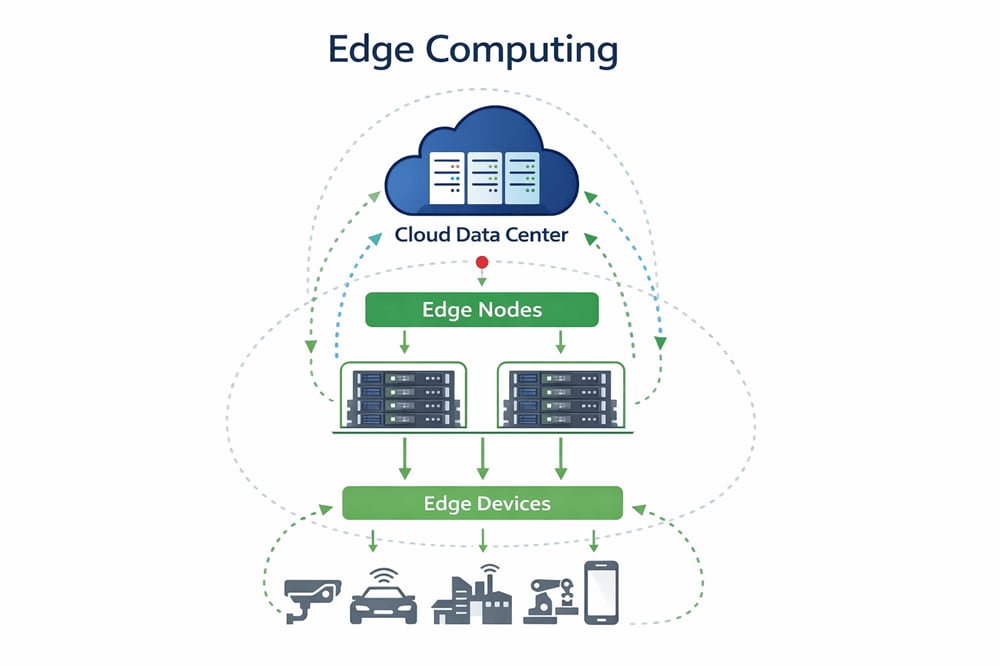

L'informatique en périphérie consiste à délocaliser des tâches informatiques essentielles, telles que l'analyse et le traitement des données, depuis des centres de données centralisés vers des sites décentralisés situés physiquement plus près du lieu de génération des données. Ce changement ne se limite pas à une simple question de géographie, mais implique une restructuration de l'architecture visant à prendre en charge des opérations urgentes, à réduire la dépendance vis-à-vis du réseau et à permettre une prise de décision en temps réel à la source. Les environnements en périphérie se composent généralement d'un système à plusieurs niveaux comprenant des terminaux périphériques, des nœuds informatiques localisés et des composants réseau qui interagissent avec les systèmes centraux selon les besoins.

Les solutions avancées de serveurs embarqués jouent un rôle crucial dans le domaine de l'informatique en périphérie. Ces serveurs sont conçus pour être économes en énergie tout en offrant des performances robustes, répondant ainsi aux exigences élevées des tâches liées à l'informatique en périphérie. Mettant l'accent sur leur engagement en faveur de l'informatique verte, ces solutions visent à minimiser l'impact environnemental. Elles y parviennent en réduisant l'empreinte carbone tout en optimisant l'efficacité opérationnelle.

Tout aussi important, ces solutions serveur sont conçues pour fonctionner de manière fiable dans des conditions environnementales difficiles. Cela garantit des performances constantes dans des environnements variés, y compris ceux qui présentent des températures extrêmes ou d'autres exigences opérationnelles. La polyvalence et la résilience de ces serveurs en font la solution idéale pour une large gamme d'applications informatiques de pointe.

Les systèmes d'informatique en périphérie sont généralement conçus dans un souci de sécurité renforcée, étant donné qu'ils traitent souvent des données sensibles en dehors des périmètres informatiques traditionnels. Les contrôles de sécurité localisés, le chiffrement et le renforcement de la sécurité des systèmes sont essentiels pour garantir l'intégrité et la confidentialité des données traitées en périphérie.

En déployant la puissance de calcul à proximité immédiate du lieu de production des données, l'informatique en périphérie permet d'accélérer les temps de traitement, de réduire la pression sur la bande passante du réseau et d'améliorer la réactivité des services et des appareils numériques.

Produits et solutions connexes

Ressources connexes

Informatique en périphérie, dans le cloud et dans le fog

Si l'informatique en périphérie, dans le cloud et dans le « fog » concernent toutes la manière dont les données sont traitées et le lieu où elles le sont, chacune d'entre elles représente une approche distincte de l'architecture informatique, avec des applications et des caractéristiques de performance différentes.

Le cloud computing repose sur des centres de données centralisés, souvent situés loin du lieu de production des données. Dans ce modèle, les données sont transmises via un réseau (généralement Internet) pour être traitées, stockées et gérées par des fournisseurs de services cloud. Cette approche offre une évolutivité et un contrôle centralisé, mais peut entraîner des délais de réponse et des limitations de bande passante, en particulier pour les applications en temps réel ou à fort volume.

À l'inverse, l'edge computing traite les données localement ou à proximité de leur source. Ce modèle réduit la distance que les données doivent parcourir et minimise la latence en analysant les informations directement sur l'appareil ou sur un nœud périphérique situé à proximité. Il est particulièrement adapté aux cas d'utilisation nécessitant une analyse ou une action immédiate, tels que les systèmes autonomes, l'automatisation industrielle ou l'analyse vidéo sur site.

Le « fog computing » sert d'intermédiaire entre les environnements en périphérie et dans le cloud. Il étend les capacités du cloud vers la périphérie en introduisant une couche de calcul distribué qui opère entre les appareils locaux et l'infrastructure cloud centralisée. Le « fog computing » permet de gérer des tâches trop gourmandes en ressources pour les appareils en périphérie, mais trop sensibles à la latence pour être traitées uniquement dans le cloud.

En substance, le cloud computing est centralisé, l'edge computing est entièrement décentralisé, tandis que le fog computing propose une approche hybride. Chaque modèle a sa place en fonction des exigences spécifiques en matière de vitesse, de bande passante, de souveraineté des données et de puissance de traitement.

Principaux avantages de l'informatique en périphérie

L'informatique en périphérie offre plusieurs avantages stratégiques et opérationnels qui en font une architecture particulièrement intéressante pour les applications modernes gourmandes en données.

L'un des principaux avantages réside dans la réduction de la latence. En traitant les données directement à la source ou à proximité, l'informatique en périphérie évite d'avoir à transmettre les informations sur de longues distances vers des systèmes centralisés. Cela réduit considérablement les temps de réponse, ce qui est essentiel pour les applications en temps réel telles que les véhicules autonomes, la réalité augmentée, l'automatisation industrielle et le diagnostic à distance en télémédecine.

Un autre avantage majeur réside dans l'efficacité de la bande passante. Le traitement localisé des données permet aux systèmes de filtrer, d'analyser et d'exploiter les données avant de ne transmettre que les informations essentielles aux plateformes cloud centralisées. Cela réduit au minimum le volume de données transitant sur le réseau, ce qui diminue l'utilisation de la bande passante et les coûts associés, ce qui s'avère particulièrement utile dans les environnements où la connectivité est limitée ou coûteuse.

Le renforcement de la sécurité et de la confidentialité des données fait également partie intégrante de l'informatique en périphérie. Le traitement des données sur site ou au sein d'une infrastructure locale réduit l'exposition des informations sensibles pendant leur transmission. Cela permet de diminuer le risque d'interception ou d'accès non autorisé, en particulier dans les secteurs soumis à des exigences réglementaires strictes, tels que la santé, la finance et les infrastructures critiques.

Enfin, l'edge computing contribue à renforcer la fiabilité du système. Les appareils et les nœuds en périphérie pouvant fonctionner indépendamment du cloud central, ils continuent de fonctionner même en cas de perturbations ou de coupures du réseau. Cette résilience locale garantit la continuité du service, même en cas de perte temporaire de la connexion à l'infrastructure centrale.

Ces avantages combinés font de l'edge computing une approche puissante pour les entreprises qui cherchent à améliorer leurs performances, à réduire les risques opérationnels et à mieux prendre en charge les environnements distribués.

Cas d'utilisation et applications

L'Edge Computing permet un traitement sur site ou à proximité, ce qui est devenu essentiel pour les secteurs nécessitant une prise de décision rapide et un contrôle localisé. Sa capacité à rapprocher la puissance de calcul de la source de génération des données a ouvert de nouvelles perspectives d'innovation, en particulier dans les environnements où la latence, la fiabilité et la réactivité sont cruciales.

Dans le secteur industriel, l'edge computing permet la maintenance prédictive, le contrôle qualité en temps réel et l'optimisation de la production grâce à l'analyse des données des capteurs directement sur le site de production. Les systèmes de santé exploitent les capacités de l'edge computing pour faciliter le diagnostic à distance, la surveillance des patients et l'imagerie médicale dans des environnements où une faible latence peut être vitale. Dans le commerce de détail, l'infrastructure edge permet la mise en place de systèmes de caisse intelligents, d'expériences client personnalisées et d'une gestion efficace des stocks grâce au traitement des données localement, en magasin.

Les véhicules autonomes s'appuient fortement sur l'informatique en périphérie pour interpréter les données des capteurs, prendre des décisions de conduite et communiquer avec les infrastructures environnantes. Tout cela se déroule en temps réel, sans dépendre d'une connexion permanente au cloud. De même, les initiatives de villes intelligentes utilisent les technologies de périphérie pour gérer les systèmes de circulation, surveiller les infrastructures de sécurité publique et optimiser la consommation d'énergie au niveau local.

L'informatique en périphérie est également étroitement liée au développement des solutions IoT en périphérie, qui consistent à traiter les données directement sur les appareils connectés ou à proximité de ceux-ci. Bien que ces applications soient variées et en pleine expansion, leurs spécificités techniques sont abordées plus en détail dans une page de glossaire dédiée à l'IoT en périphérie.

En tant que pilier essentiel de l'informatique distribuée, l'architecture de périphérie permet aux organisations d'étendre leurs capacités informatiques au monde physique, favorisant ainsi une prise de décision plus rapide, des systèmes plus résilients et des modèles de déploiement évolutifs. De l'automatisation industrielle aux soins de santé connectés en passant par les systèmes de transport intelligents, l'informatique de périphérie joue un rôle crucial dans la mise en place d'écosystèmes numériques rapides, efficaces et adaptables au sein des entreprises modernes.

Défis et considérations

Si l'edge computing offre des avantages évidents en termes de rapidité, d'évolutivité et d'efficacité, il pose également un ensemble de défis spécifiques que les entreprises doivent relever pour garantir la réussite de son déploiement et de son exploitation.

L'une des principales préoccupations concerne la complexité de la gestion. Les ressources informatiques étant réparties sur plusieurs sites périphériques, il peut devenir de plus en plus difficile de maintenir des normes cohérentes en matière de performances, de sécurité et de configuration. Cela est d'autant plus vrai lorsque ces sites sont situés dans des environnements éloignés ou soumis à des contraintes physiques. Pour surmonter cette difficulté, les équipes informatiques doivent gérer un large éventail de composants matériels, logiciels et réseau répartis sur des sites décentralisés.

La sécurité et la protection des données constituent également des enjeux cruciaux. Bien que le traitement des données en local puisse réduire les risques liés à leur transmission, les terminaux et les nœuds périphériques peuvent être plus facilement accessibles physiquement ou fonctionner en dehors des périmètres de sécurité traditionnels de l'entreprise. Cela renforce la nécessité de disposer d'une protection robuste des terminaux, de processus de démarrage sécurisés et d'une surveillance en temps réel afin de se prémunir contre tout accès non autorisé ou toute altération.

L'interopérabilité et la normalisation constituent un autre défi. Les environnements en périphérie impliquent souvent une grande diversité d'appareils, de plateformes et de protocoles. Garantir la compatibilité entre ces composants, en particulier dans les environnements multi-fournisseurs ou hérités, peut avoir des répercussions tant sur les efforts d'intégration que sur l'évolutivité à long terme.

De plus, les coûts d'infrastructure peuvent être considérables. Si l'informatique en périphérie allège la charge pesant sur les centres de données centralisés, le déploiement et la maintenance à grande échelle du matériel en périphérie nécessitent des investissements dans des systèmes robustes, des sources d'alimentation fiables et une connectivité sécurisée. Le retour sur investissement dépend fortement du cas d'utilisation, de l'ampleur du déploiement et de la stratégie opérationnelle.

Enfin, les entreprises doivent tenir compte du cycle de vie des données à la périphérie. Les décisions concernant les données à traiter localement, celles à supprimer et celles à envoyer vers le cloud pour un stockage à long terme ou à des fins d'analyse nécessitent une planification minutieuse et une application rigoureuse des politiques afin de trouver un équilibre entre les performances et les exigences réglementaires et commerciales.

Termes clés de l'Edge Computing

Il est essentiel de comprendre les éléments fondamentaux de l'informatique en périphérie pour saisir le fonctionnement des architectures distribuées. Voici quelques termes importants couramment associés aux environnements en périphérie :

Nœud périphérique

Un nœud périphérique est un terminal informatique localisé qui traite ou transmet les données générées par les appareils situés à proximité. Il constitue généralement le premier niveau de traitement dans la hiérarchie de l'informatique en périphérie, permettant ainsi un filtrage des données ou une prise de décision en temps réel plus près de la source.

Passerelle

Une passerelle sert de pont entre les périphériques en périphérie et les réseaux ou systèmes centraux. Elle gère le trafic de données, assure la traduction des protocoles et effectue souvent des tâches de traitement ou de sécurité de base avant de transférer les données en amont ou en aval.

Micro-centre de données

Les micro-centres de données sont des installations compactes et autonomes qui fournissent des ressources de calcul, de stockage et de mise en réseau à proximité du lieu d'utilisation. Ils prennent en charge des applications spécifiques ou des charges de travail localisées, réduisant ainsi la nécessité d'envoyer des données vers des centres de données éloignés.

Appareil périphérique

Un dispositif en périphérie désigne tout terminal, tel qu'un capteur, une caméra ou un contrôleur industriel, qui génère ou utilise des données au sein d'un environnement d'informatique en périphérie. Ces dispositifs disposent souvent d'une capacité de traitement limitée afin de permettre des réponses en temps réel.

Edge Orchestrator

Un orchestrateur de périphérie est une couche logicielle ou une plateforme qui gère, déploie et surveille les charges de travail sur plusieurs nœuds de périphérie. Il permet un contrôle centralisé d'une infrastructure décentralisée, contribuant ainsi à garantir la cohérence et l'évolutivité du système.

latence

En informatique en périphérie, la latence désigne le délai entre le moment où les données sont générées et celui où elles sont traitées ou exploitées. La réduction de la latence est l'un des principaux objectifs de la mise en place de ressources informatiques à proximité de la source des données.

Traitement en temps réel

Ce terme désigne la capacité d'un système à collecter, analyser et exploiter des données en quelques millisecondes. L'Edge Computing facilite le traitement en temps réel en réduisant au minimum les délais de transmission et en permettant un calcul local immédiat.

FAQ

- Quelle est la différence entre l'edge computing et le cloud computing ?

Si l'edge computinget le cloud computingimpliquent tous deux le stockage et le traitement des données, la principale différence réside dans leur emplacement. Le cloud computing centralise le traitement dans de grands centres de données, souvent situés loin des utilisateurs finaux. À l'inverse, l'edge computing traite les données plus près de l'endroit où elles sont générées. - En quoi l'edge computing améliore-t-il l'IoT ?

L'edge computingcomplète l'IoTen permettant aux appareils de traiter et d'analyser les données localement, plutôt que de les envoyer vers un cloud central pour y être traitées. Cela permet une prise de décision plus rapide, un avantage essentiel pour les applications où le temps est un facteur crucial, telles que l'automatisation industrielle, les villes intelligentes ou les systèmes autonomes. - L'edge computing est-il plus sûr que le cloud computing ?

L'edge computing peut améliorer la confidentialité et la sécurité des données en limitant la distance parcourue par les données sensibles, ce qui réduit leur exposition pendant la transmission. Cependant, il pose également de nouveaux défis en matière de sécurité, tels que la gestion d'un grand nombre de terminaux distribués. Les environnements edge et cloud nécessitent tous deux des stratégies de sécurité complètes et adaptées au contexte. - Pourquoi l'edge computing est-il important pour la 5G ?

L'edge computingest essentiel pour les réseaux 5G car il contribue à réduire la latence. La 5G permettant une transmission de données plus rapide, l'infrastructure en périphérie garantit que le traitement puisse suivre le rythme, en particulier pour les applications mobiles et celles qui nécessitent une bande passante importante. - Quels sont les exemples concrets d'edge computing ?

Parmiles exemples concrets d'edge computing, on peut citer les véhicules autonomes qui traitent les données des capteurs en temps réel, les magasins de détail qui utilisent des analyses en magasin pour étudier le comportement des clients, et les installations industrielles qui déploient des systèmes de maintenance prédictive dans leurs ateliers. Ces scénarios nécessitent un traitement immédiat des données sans avoir recours à des centres de données distants.