Saviez-vous que la formation d'un seul modèle d'IA peut émettre autant de carbone que cinq voitures au cours de leur vie ? 5 conseils pour réduire l'impact environnemental !

Des chercheurs de l'université du Massachusetts, à Amherst, ont réalisé une évaluation du cycle de vie pour la formation de plusieurs grands modèles d'intelligence artificielle courants. Ils ont constaté que le processus peut émettre plus de 626 000 livres de dioxyde de carbone, ce qui équivaut à environ cinq fois les émissions d'une voiture américaine moyenne pendant toute sa durée de vie (y compris la fabrication de la voiture elle-même).

Des études ont montré que : L'empreinte carbone de la formation à l'IA est importante et est due à l'énergie nécessaire pour alimenter les ordinateurs utilisés pour former les modèles. Les émissions de carbone associées à la formation à l'IA peuvent être réduites en utilisant des énergies renouvelables pour alimenter les centres de données.

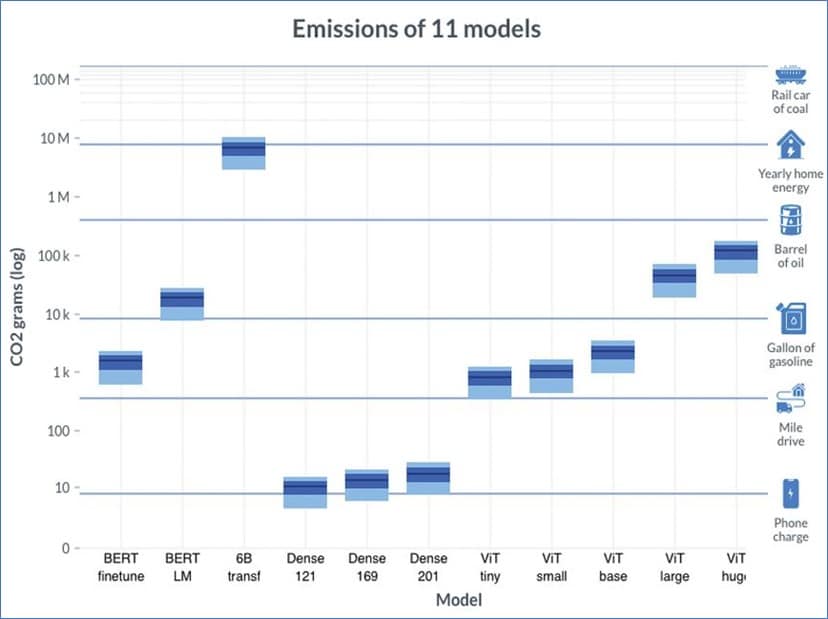

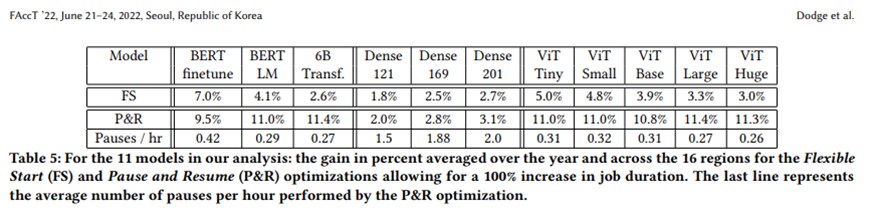

Les algorithmes efficaces réduisent les émissions de carbone en réduisant l'énergie nécessaire pour former les modèles d'IA, tels que les algorithmes approximatifs qui fournissent de bonnes solutions aux problèmes sans garantir la meilleure solution possible, ou les algorithmes basés sur les données qui sont formés sur les données. Le tableau ci-dessous montre les résultats de l'utilisation de deux algorithmes d'optimisation : Flexible Startqui offre une certaine souplesse pour les charges de travail d'IA composées de tâches plus courtes, et Pause et reprise qui met en pause et reprend en fonction d'un seuil, pour les tâches plus longues.

La mise en pause d'une charge de travail d'IA lorsque les émissions régionales sont élevées peut réduire les totaux globaux. Les économies peuvent être importantes, jusqu'à 25 % pour les séries très longues. Les économies sont moindres pour les cycles courts, car la durée doublée est encore relativement courte. Le tableau montre également que le nombre de pauses par heure augmente avec la taille du modèle. Cela s'explique par le fait que les modèles plus importants nécessitent une plus grande puissance de calcul et prennent donc plus de temps à former.

Cinq conseils et technologies innovantes pour réduire les émissions de carbone de la formation à l'IA

- Utiliser du matériel économe en énergie, ce qui peut inclure des GPU.

- Les GPU sont plus efficaces sur le plan énergétique que les CPU en termes de travail par watt pour certaines charges de travail. Les GPU peuvent être utilisés pour former des modèles d'IA plus rapidement et donc consommer moins d'énergie qu'un environnement purement CPU.

- Le refroidissement par liquide peut être utilisé pour refroidir plus efficacement le matériel informatique, réduisant ainsi la consommation d'énergie et les émissions dans les centres de données. Il peut également réduire le bruit jusqu'à 50 % et créer un environnement de travail plus confortable. Il est plus facile à entretenir que le refroidissement par air et les refroidisseurs de liquide sont moins susceptibles d'être endommagés.

- Optimiser l'efficacité énergétique des centres de données. Il existe plusieurs moyens de réduire la consommation d'énergie des centres de données, comme le refroidissement à air libre, qui réduit le PUE. Systèmes de refroidissement plus efficaces : Les centres de données traditionnels refroidis par air utilisent une quantité importante d'énergie pour refroidir les serveurs.

- Des blocs d'alimentation plus efficaces : Les blocs d'alimentation conventionnels peuvent être inefficaces et gaspiller jusqu'à 20 % de l'énergie qu'ils utilisent. Veillez à utiliser des blocs d'alimentation en titane ou en platine.

- Des serveurs plus efficaces : Utiliser des serveurs multi-nœuds qui peuvent partager les ressources, ce qui réduit la consommation globale d'énergie par serveur.

- Utiliser les énergies renouvelables pour alimenter la formation à l'IA. Les centres de données qui se consacrent à la formation à l'IA peuvent être alimentés par des sources d'énergie renouvelables : énergie solaire ou éolienne.

- Améliorer l'efficacité de la formation à l'IA. Des technologies innovantes telles que l'informatique quantique, les réseaux neuronaux à pointes, l'apprentissage fédéré, l'apprentissage par transfert et la recherche d'architectures neuronales peuvent améliorer l'efficacité de la formation à l'IA et réduire la consommation d'énergie.

- Utiliser des modèles pré-entraînés. Les modèles pré-entraînés ont déjà été entraînés sur un grand ensemble de données et n'ont pas besoin d'être développés à partir de zéro, ce qui consomme de l'énergie.

Suivez ces conseils pour rendre l'IA plus durable.

Sources :

Mesurer l'empreinte carbone de l'IA - IEEE Spectrum

Archives de l'informatique économe en énergie - Cambridge Open Zettascale Lab

Mesurer l'intensité carbone de l'IA dans les instances en nuage (facctconference.org)