Sistemas de servidor GPU

Sistemas GPU sin rival: Servidores optimizados para aprendizaje profundo para el centro de datos moderno

NVIDIA GB300 NVL72

Liquid Cooled Rack-Scale Solution with 72 NVIDIA B300 GPUs and 36 Grace CPUs

- GPU: 72 NVIDIA B300 GPUs via NVIDIA Grace Blackwell Superchips

- CPU: 36 NVIDIA Grace CPUs via NVIDIA Grace Blackwell Superchips

- Memory: Up to 21 TB HBM3e (GPU Memory), Up to 17 TB LPDDR5X (System Memory)

- Drives: up to 144 E1.S PCIe 5.0 drive bays

Liquid-Cooled Universal GPU Systems

Direct-to-chip liquid-cooled systems for high-density AI infrastructure at scale.

- GPU: NVIDIA HGX B300/B200/H200

- CPU: Intel® Xeon® or AMD EPYC™

- Memory: Up to 32 DIMMs, 9TB

- Drives: Up to 24 Hot-swap U.2 or 2.5" NVMe/SATA drives

Universal GPU Systems

Modular Building Block Design, Future Proof Open-Standards Based Platform in 4U, 5U, 8U, or 10U for Large Scale AI training and HPC Applications

- GPU: NVIDIA HGX B300/B200/H200, AMD Instinct MI350 Series and MI325X/MI300X/MI250 OAM Accelerator, Intel Data Center GPU Max Series

- CPU: Intel® Xeon® or AMD EPYC™

- Memory: Up to 32 DIMMs, 9TB

- Drives: Up to 24 Hot-swap E1.S, U.2 or 2.5" NVMe/SATA drives

3U/4U/5U GPU Lines with PCIe 5.0

Maximum Acceleration and Flexibility for AI, Deep Learning and HPC Applications

- GPU: Up to 10 NVIDIA H100 PCIe GPUs, or up to 10 double-width PCIe GPUs

- CPU: Intel® Xeon® or AMD EPYC™

- Memory: Up to 32 DIMMs, 9TB or 12TB

- Drives: Up to 24 Hot-swap 2.5" SATA/SAS/NVMe

NVIDIA MGX™ Systems

Modular Building Block Platform Supporting Today's and Future GPUs, CPUs, and DPUs

- GPU: Up to 4 NVIDIA PCIe GPUs including NVIDIA RTX PRO™ 6000 Blackwell Server Edition, H200 NVL, H100 NVL, and L40S

- CPU: NVIDIA GH200 Grace Hopper™ Superchip, Grace™ CPU Superchip, or Intel® Xeon®

- Memory: Up to 960GB ingegrated LPDDR5X memory (Grace Hopper or Grace CPU Superchip) or 16 DIMMs, up to 4TB DRAM (Intel)

- Drives: Up to 8 E1.S + 4 M.2 drives

AMD APU Systems

Multi-processor system combining CPU and GPU, Designed for the Convergence of AI and HPC

- GPU: 4 AMD Instinct MI300A Accelerated Processing Unit (APU)

- CPU: AMD Instinct™ MI300A Accelerated Processing Unit (APU)

- Memory: Up to 512GB integrated HBM3 memory (4x 128GB)

- Drives: Up to 8 2.5" NVMe or Optional 24 2.5" SATA/SAS via storage add-on card + 2 M.2 drives

4U GPU Lines with PCIe 4.0

Flexible Design for AI and Graphically Intensive Workloads, Supporting Up to 10 GPUs

- GPU: NVIDIA HGX A100 8-GPU with NVLink, or up to 10 double-width PCIe GPUs

- CPU: Intel® Xeon® or AMD EPYC™

- Memory: Up to 32 DIMMs, 8TB DRAM or 12TB DRAM + PMem

- Drives: Up to 24 Hot-swap 2.5" SATA/SAS/NVMe

2U 2-Node Multi-GPU with PCIe 4.0

Dense and Resource-saving Multi-GPU Architecture for Cloud-Scale Data Center Applications

- GPU: Up to 3 double-width PCIe GPUs per node

- CPU: Intel® Xeon® or AMD EPYC™

- Memory: Up to 8 DIMMs, 2TB per node

- Drives: Up to 2 front hot-swap 2.5” U.2 per node

GPU Workstation

Flexible Solution for AI/Deep Learning Practitioners and High-end Graphics Professionals

- GPU: Up to 4 double-width PCIe GPUs

- CPU: Intel® Xeon®

- Memory: Up to 16 DIMMs, 6TB

- Drives: Up to 8 hot-swap 2.5” SATA/NVMe

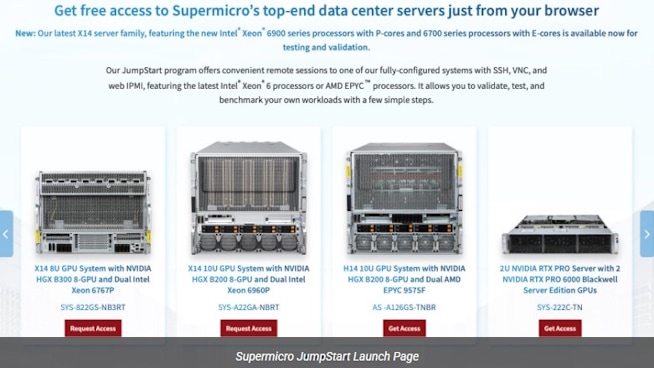

Análisis de Supermicro JumpStart: Una semana con un NVIDIA HGX B200.

El programa JumpStart de Supermicro adopta un enfoque muy diferente para la evaluación de hardware. En lugar de una demostración breve y guionizada en un entorno de laboratorio compartido, JumpStart ofrece a los clientes cualificados acceso gratuito, con límite de tiempo y bare-metal, a un catálogo de servidores de producción reales.

Protección de cargas de trabajo de IA con Intel® TDX, NVIDIA Confidential Computing y Supermicro Servers con GPU NVIDIA HGX™ B200: Una base para la IA confidencial a escala

Este libro blanco explora cómo las Trust Domain Extensions (TDX) de Intel y NVIDIA Confidential Computing, junto con los sistemas basados en HGX B200 de Supermicro, proporcionan una plataforma potente, segura y escalable para la infraestructura de IA de próxima generación.

Los servicios en la nube de Sakura Internet Koukaryoku aceleran los servicios de IA

Sakura Internet Koukaryoku Crea Nuevos Servicios con el sistema 8U SYS-821GE-TNR de Supermicro, que incorpora la plataforma de supercomputación de IA NVIDIA HGX™ de 8 GPUs, acelerando las aplicaciones de IA generativa.

Supermicro SYS-821GE-TNHR: Servidor de IA refrigerado por aire con 8 GPU NVIDIA H200

Hoy continuamos nuestro análisis de servidores de IA masivos con un vistazo al Supermicro SYS-821GE-TNHR. Cuando se habla de la destreza de Supermicro en servidores de IA, este es uno de los sistemas que se distingue en el mercado como un servidor NVIDIA refrigerado por aire.

Supermicro con GAUDI 3 AI Ofrece Rendimiento Escalable para Requisitos de IA

Gama de soluciones optimizadas para centros de datos de cualquier tamaño y carga de trabajo Para nuevos servicios y mayor satisfacción del cliente

Supermicro y los sistemas Intel GAUDI 3 impulsan la infraestructura de IA empresarial

Sistema de IA de gran ancho de banda que utiliza procesadores Intel Xeon 6 para el entrenamiento y la inferencia eficientes de LLM y GenAI a escala empresarial

Lamini elige servidores GPU de Supermicro para su oferta de ajuste de LLM.

Utilizando servidores GPU de Supermicro con los aceleradores AMD Instinct™ MI300X, Lamini es capaz de ofrecer ajuste de LLM a alta velocidad.

El sistema Supermicro Grace ofrece un rendimiento 4 veces superior para ANSYS® LS-DYNA®

Los sistemas Superchip de CPU Supermicro Grace ofrecen un rendimiento 4 veces superior con el mismo consumo energético

Applied Digital construye una nube de IA masiva con servidores GPU Supermicro

Applied Digital ofrece a los usuarios lo último en infraestructura escalable de IA y HPC para el entrenamiento de IA y simulaciones HPC con servidores Supermicro de alto rendimiento

Servidores GPU Supermicro AMD EPYC de 4U que ofrecen flexibilidad de IA (AS-4125GS-TNRT)

Supermicro ha ofrecido desde hace tiempo servidores GPU en más formas y tamaños de los que podemos abordar en esta revisión. Hoy, analizamos su servidor GPU de 4U refrigerado por aire, relativamente nuevo, que soporta dos CPU AMD EPYC 9004 Series, PCIe Gen5, y una selección de ocho tarjetas GPU adicionales de doble ancho o 12 de ancho simple.

Supermicro y NVIDIA crean soluciones para acelerar las simulaciones CFD para las industrias automotriz y aeroespacial.

Servidores Supermicro con GPUs NVIDIA para centros de datos ofrecen una aceleración significativa para simulaciones CFD, reduciendo el tiempo de comercialización para empresas manufactureras

Un vistazo al servidor de IA Supermicro SYS-821GE-TNHR 8x NVIDIA H100 refrigerado por líquido

Hoy queríamos examinar el servidor Supermicro SYS-821GE-TNHR con refrigeración líquida. Este es el sistema 8x NVIDIA H100 de Supermicro con una particularidad: está refrigerado por líquido para reducir los costes de refrigeración y el consumo de energía. Dado que teníamos las fotos, pensamos en incluirlo en un artículo.

Opciones de acceso a las GPU PCIe en una arquitectura de servidor de alto rendimiento

Comprender las opciones de configuración para servidores GPU Supermicro ofrece el máximo rendimiento para las cargas de trabajo.

Petrobras Adquiere Servidores Supermicro Integrados por Atos para Reducir Costos y Aumentar la Precisión de la Exploración

Los sistemas Supermicro impulsan a Petrobras a la posición #33 en el Top500, Clasificaciones de noviembre de 2022

Supermicro ProphetStor maximizan la eficiencia de la GPU para el entrenamiento LLM multitenant

En el dinámico mundo de la IA y el aprendizaje automático, la gestión eficiente de los recursos de la GPU en entornos multiusuario es primordial, sobre todo para el entrenamiento de grandes modelos lingüísticos (LLM).

Los servidores Supermicro amplían su oferta de GPU para SEEWEB, proporcionando a los clientes exigentes resultados más rápidos para cargas de trabajo de IA y HPC

Seeweb selecciona servidores GPU de Supermicro para satisfacer las demandas de los clientes en cargas de trabajo de HPC e IA

Servidor GPU universal H12

Diseño de servidor basado en estándares abiertos para una mayor flexibilidad arquitectónica

Desmontaje del servidor AMD EPYC de 3000W, con Wendell de Level1Techs

Estamos ante un servidor optimizado para IA y aprendizaje automático. Supermicro ha trabajado arduamente para integrar la mayor cantidad posible de componentes en el 2114GT-DNR (2U2N), un servidor optimizado para la densidad. Esta es una construcción realmente ingeniosa: hay dos sistemas en este chasis 2U. Las dos fuentes de alimentación redundantes son de 2.600 W cada una y veremos por qué necesitamos tanta potencia. Aloja seis GPU AMD MI210 Instinct y los procesadores duales Epyc. Vea el nivel de ingeniería que Supermicro ha invertido en el diseño de este servidor.

H12 2U Multi-GPU de 2 nodos

Diseño multinodo para la densidad de cálculo y aceleración de la GPU

NEC Impulsa la Investigación en IA con Sistemas GPU Avanzados de Supermicro

NEC utiliza servidores GPU de Supermicro con NVIDIA® A100s para la construcción de un superordenador destinado a la investigación en IA (En japonés)

Supermicro TECHTalk: Servidor de alta densidad para entrenamiento de IA/aprendizaje profundo

Nuestro sistema para centros de datos más reciente incluye la mayor densidad de GPU NVIDIA Ampere avanzadas con una rápida interconexión GPU-GPU y procesadores Intel® Xeon® Scalable de 3ª generación. En esta TECHTalk, mostraremos cómo hacemos posible un rendimiento de IA sin precedentes en un paquete de 4U de altura de rack.

Demostración práctica de la plataforma de estación de trabajo-servidor GPU híbrida 2U2N Supermicro SYS-210GP-DNR

Hoy finalizamos nuestra última serie analizando el Supermicro SYS-210GP-DNR, un sistema 2U de 2 nodos y 6 GPU con el que Patrick tuvo la oportunidad de trabajar recientemente en la sede de Supermicro.

Supermicro SYS-220GQ-TNAR+ un servidor 2U NVIDIA Redstone

Hoy analizamos el Supermicro SYS-220GQ-TNAR+ con el que Patrick tuvo la oportunidad de trabajar recientemente en la sede de Supermicro.

Presentando el salto en el diseño de sistemas GPU - TECHTalk SC21 de Supermicro con IDC

Presentado por Josh Grossman, director principal de productos Supermicro Peter Rutten, director de investigación de sistemas de infraestructura de IDC.

Soluciones para servidores de misión crítica

Maximización del desarrollo y la entrega de IA con las GPU NVIDIA A100 virtualizadas

Los sistemas Supermicro con NVIDIA HGX A100 ofrecen un conjunto flexible de soluciones para soportar NVIDIA Virtual Compute Server (vCS) y GPU NVIDIA A100, permitiendo el desarrollo y la implementación de IA para ejecutar modelos de IA pequeños y grandes.

Supermicro SuperMinute: Servidor 2U de 2 nodos

La innovadora plataforma multinodo GPU/CPU de Supermicro es diferente a cualquier producto existente en el mercado. Con nuestro avanzado diseño de Soluciones modulares® y arquitectura de ahorro de recursos, este sistema aprovecha los motores de CPU y GPU más avanzados junto con almacenamiento avanzado de alta densidad en un formato de ahorro de espacio, ofreciendo una eficiencia energética y flexibilidad inigualables.

SuperMinute: Sistema 4U con HGX A100 8-GPU

Para las cargas de trabajo de IA más exigentes, Supermicro construye los servidores de mayor rendimiento y más rápidos de comercializar basados en las GPU NVIDIA A100™ Tensor Core. Con la versión más reciente de las tecnologías NVIDIA® NVLink™ y NVIDIA NVSwitch™, estos servidores pueden ofrecer hasta 5 PetaFLOPS de rendimiento de IA en un único sistema 4U.

SuperMinute: Sistema 2U con HGX A100 4-GPU

El nuevo servidor AS -2124GQ-NART cuenta con la potencia de las GPU NVIDIA A100 Tensor Core y la placa base HGX A100 de 4 GPU. El sistema admite PCI-E Gen 4 para una rápida conexión CPU-GPU y tarjetas de expansión de red de alta velocidad.