Beschleunigte Building Blocks mit Intel-GPUs

Supermicro

Entwickelt zur Beschleunigung

Für KI und -Inferenz im Cloud-Maßstab

Die Nachfrage nach hochleistungsfähigen KI Learning (DL)-Trainingscomputern hat sich laut OpenAI seit 2013 alle 3,5 Monate verdoppelt und steigt mit der wachsenden Größe der Datensätze und der Anzahl der Anwendungen und Dienste, die auf großen Sprachmodellen (LLMs), Computer Vision, Empfehlungssystemen und mehr basieren.

Angesichts der gestiegenen Nachfrage nach höherer Trainings- und Inferenzleistung, Durchsatz und Kapazität benötigt die Industrie zweckgebundene Systeme, die eine höhere Effizienz, geringere Kosten, einfache Implementierung, Flexibilität zur Anpassung und Skalierung von KI-Systemen bieten. KI ist zu einer unverzichtbaren Technologie für vielfältige Bereiche wie Copiloten, virtuelle Assistenten, Fertigungsautomatisierung, autonome Fahrzeugoperationen und medizinische Bildgebung geworden, um nur einige zu nennen. Supermicro hat sich mit Intel zusammengetan, um Cloud-Scale-System- und Rack-Designs mit Intel Gaudi KI-Beschleunigern anzubieten.

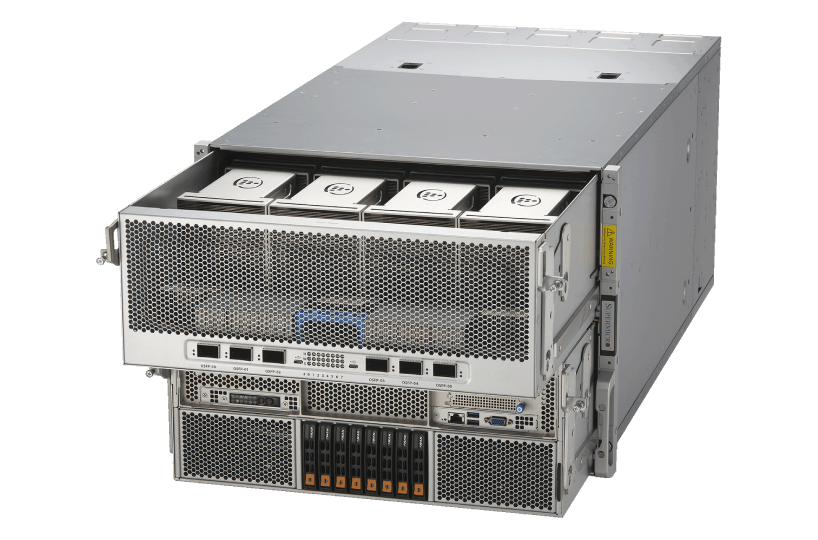

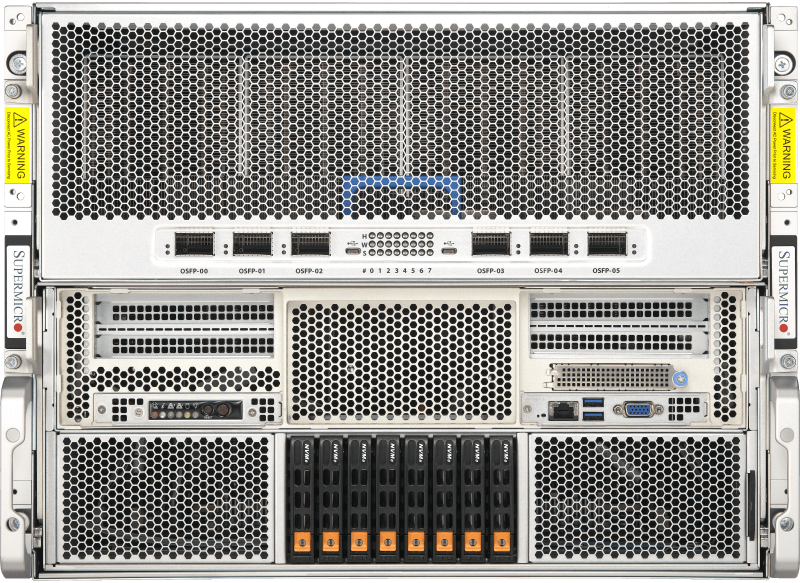

Neue Supermicro X14 Gaudi® 3 KI-Trainings- und Inferenzplattform

Um dem Enterprise-KI-Markt mehr Auswahl zu bieten, basiert die neue Supermicro X14 KI-Trainingsplattform auf den Intel® Gaudi 3 Beschleunigern der dritten Generation, die darauf ausgelegt sind, die Effizienz des großskaligen KI-Modelltrainings und der KI-Inferenz weiter zu steigern. Verfügbar in luftgekühlten und flüssigkeitsgekühlten Konfigurationen, skaliert die Supermicro X14 Gaudi 3 Lösung problemlos, um eine Vielzahl von KI-Workload-Anforderungen zu erfüllen.

- GPU: 8 Gaudi 3 HL-325L (luftgekühlt) oder HL-335 (flüssigkeitsgekühlt) Beschleuniger auf OAM 2.0 Baseboard

- CPU: Zwei Intel® Xeon® 6 Prozessoren

- Speicher: 24 DIMMs - bis zu 6 TB Speicher in 1DPC

- Laufwerke: Bis zu 8 hot-swap PCIe 5.0 NVMe

- Stromversorgungen: 8 3000W hocheffiziente, voll redundante (4+4) Titanium Level

- Netzwerk: 6 integrierte OSFP 800GbE-Ports für Scale-out

- Erweiterungssteckplätze: 2 PCIe 5.0 x16 (FHHL) + 2 PCIe 5.0 x8 (FHHL)

- Arbeitsbelastungen: KI und Inferenz

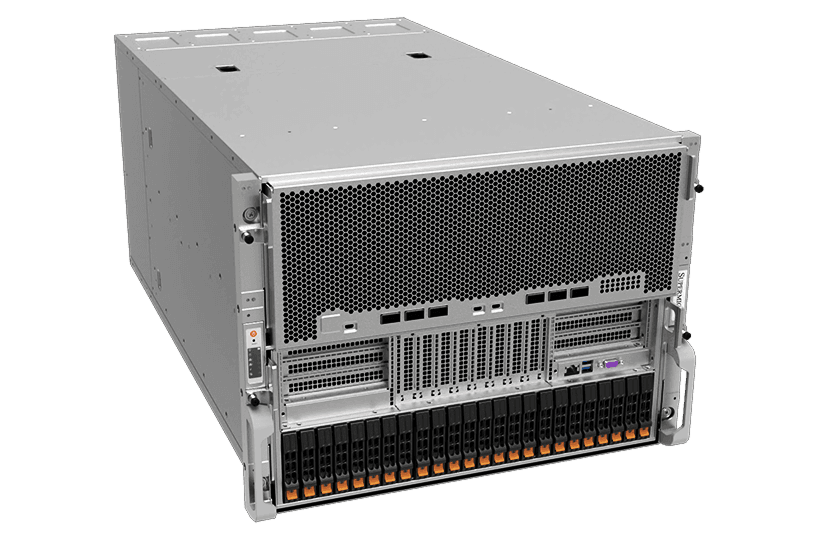

Supermicro Gaudi®2 KI-Trainingsserver

Aufbauend auf dem Erfolg des ursprünglichen Supermicro Gaudi KI-Trainingssystems, priorisiert der Gaudi 2 KI-Server zwei wesentliche Aspekte: die Integration von KI-Beschleunigern mit integrierten Hochgeschwindigkeits-Netzwerkmodulen zur Steigerung der Betriebseffizienz beim Training modernster KI-Modelle und der KI-Branche die benötigte Auswahl zu bieten.

- GPU: 8 Gaudi2 HL-225H Mezzanine-Karten

- CPU: Zwei Intel® Xeon® Prozessoren der 3. Generation, skalierbar

- Speicher: 32 DIMMs - bis zu 8TB registrierter ECC DDR4-3200MHz SDRAM

- Laufwerke: bis zu 24 Hot-Swap-fähige Laufwerke (SAS)

- Leistung: 6x 3000W Hocheffiziente (54V+12V) voll-redundante Netzteile

- Vernetzung: 24x 100GbE (48 x 56Gb) PAM4 SerDes Links durch 6 QSFP-DDs

- Erweiterungssteckplätze: 2x PCIe 4.0-Switches

- Arbeitsbelastungen: KI und Inferenz

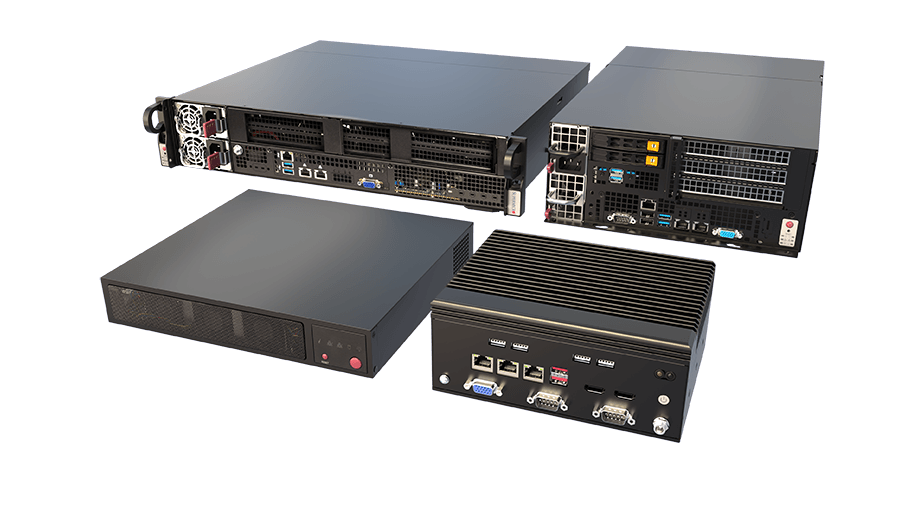

KI und Effizienz am Netzwerkrand – mit Technologie von Intel

Nutzen Sie leistungsstarke, energieeffiziente KI speziell entwickelten Systemlösungen von Intel und Supermicro. Das Portfolio Supermicroumfasst eine breite Palette fortschrittlicher CPUs und GPUs, die auch in Umgebungen mit begrenztem Platzangebot und an abgelegenen Standorten hochleistungsfähige KI mit geringer Latenz liefern und Unternehmen dabei unterstützen, datengesteuerte Anwendungen zuverlässig zu skalieren.

- Optimieren Sie die Leistung mit integrierten CPU-, GPU- und NPU-Architekturen

- Schnellere KI mit OpenVINO

- Setzen Sie zuverlässige, energieeffiziente KI Branchen wie dem Einzelhandel, dem Gesundheitswesen und der Fertigungsindustrie ein

Beschleunigung von KI am Netzwerkrand

KI und Effizienz am intelligenten Edge – mit Technologie von Intel

Supermicro und Intel® Xeon® mit Gaudi® 3 zeigen bemerkenswerte Leistung

Supermicro und Intel® arbeiten zusammen, um eine hybride CPU+GPU-Architektur für skalierbare, kosteneffiziente LLM-Inferenz unter Verwendung von Intel® Xeon® 6 und Intel® Gaudi® 3 anzubieten.

Supermicro Server mit Intel® Gaudi® 3 ist für reale KI-Szenarien optimiert

Neue Supermicro Server mit Intel® Xeon® Prozessoren der 6er-Serie mit P-Cores und Intel Gaudi 3 Beschleunigern zeigen Leistungssteigerungen gegenüber früheren Generationen

Supermicro X14 Intel® Gaudi® KI-Beschleuniger-Cluster-Referenzdesign

Beschleunigung und Kostensenkung von KI-Lösungen mit Supermicros X14 Intel® Gaudi® 3 Beschleuniger-basiertem System durch den Aufbau auf Open-Source-Software und Industriestandard-Ethernet

Supermicro mit GAUDI 3 KI liefert skalierbare Leistung für KI-Anforderungen

Optimierte Lösungen für Rechenzentren jeder Größe und Arbeitslast für neue Services und höhere Kundenzufriedenheit

Supermicro und Intel GAUDI 3 Systeme fördern die Enterprise KI-Infrastruktur

KI mit hoher Bandbreite unter Verwendung von Intel Xeon 6 Prozessoren für effizientes LLM- und GenAI-Training und Inferenz über Unternehmensskalen hinweg

Supermicro X13 Hyper ermöglicht KI-Workloads für Unternehmen auf der VMware-Plattform.

Rechnerische KI Anwendungsfälle: Large Language Model (LLM) und KI - ResNet50 auf Intel® Data Center Flex 170 GPU

Beschleunigung von KI-Berechnungen mit Supermicro Servern in der INTEL® Developer Cloud

Supermicro Advanced KI-Server mit Intel® Xeon® Prozessoren und Intel® Gaudi® 2 KI-Beschleunigern bieten Entwicklern und Unternehmen hochleistungsfähiges, hocheffizientes KI-Cloud-Computing, Training und Inferencing

Überlegene Lösung für Medienverarbeitung und -bereitstellung Basierend auf Supermicro Servern mit Intel® Data Center GPU Flex Series

Supermicro Systeme mit Intel® Data Center GPU Flex Serie

Supermicro TECHTalk: Neue Medienverarbeitungslösungen basierend auf der Intel Data Center GPU Flex Serie

Erfahren Sie von unseren Produktexperten mehr über die neuen Supermicro Lösungen, die auf der kürzlich angekündigten Intel Data Center GPU Flex Series basieren. Erfahren Sie, wie diese Lösungen Ihnen und Ihrem Unternehmen zugutekommen können.

Bereitstellung von skalierbarem Cloud-Gaming

Supermicro Systeme mit Intel® Data Center GPU Flex Serie

Supermicro bietet alle Systemkomponenten für Cloud-Service-Anbieter, um eine grüne, kosteneffiziente und profitable Cloud-Gaming-Infrastruktur aufzubauen.

Innovative Lösungen für Cloud Gaming, Medien, Transcoding und KI

Sep 08 2022, 10:00 Uhr PDT

Produkt- und Lösungs-Experten von Supermicro und Intel werden in einer informellen Sitzung die Vorteile der Lösungen in den Bereichen Cloud Gaming, Media Delivery, Transcoding und KI-Inferencing unter Verwendung der kürzlich angekündigten Intel Flex Series GPUs erörtern. Das Webinar wird die Vorteile der Supermicro Lösungen, die idealen Server und die Vorteile der Verwendung der Intel Flex Series GPUs erläutern.

Supermicro und Habana® Hochleistungs- und hocheffizientes KI-Trainingssystem

Ermöglicht ein bis zu 40 % besseres Preis-Leistungs-Verhältnis für Deep Learning-Training als herkömmliche KI