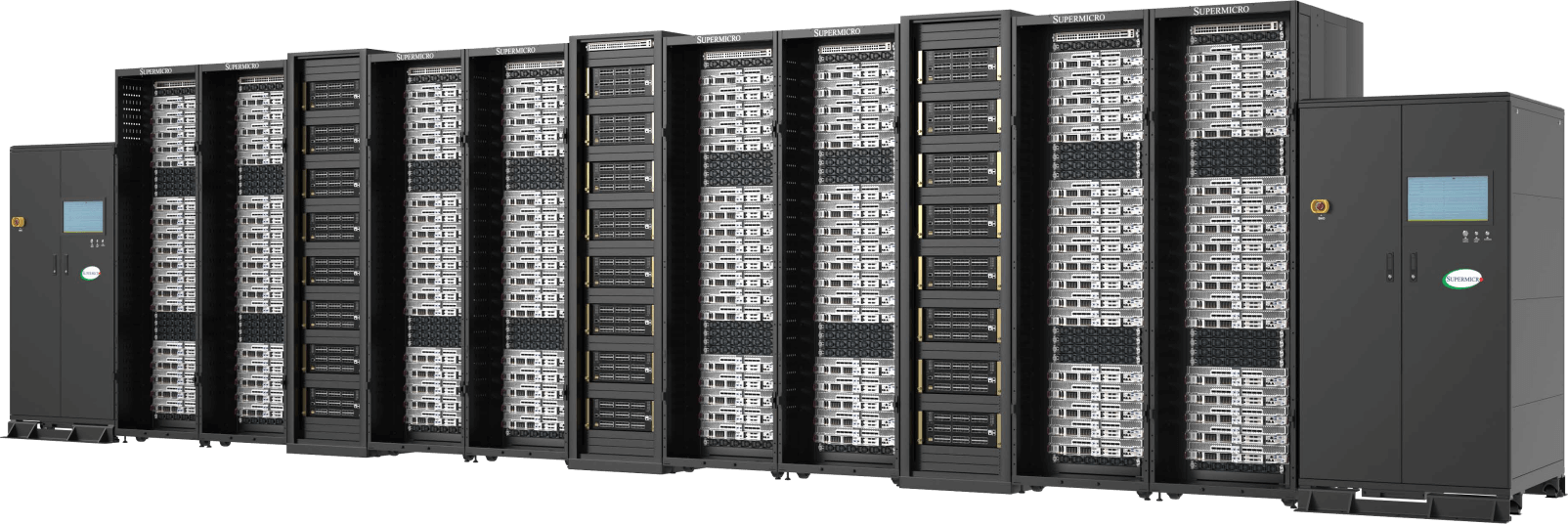

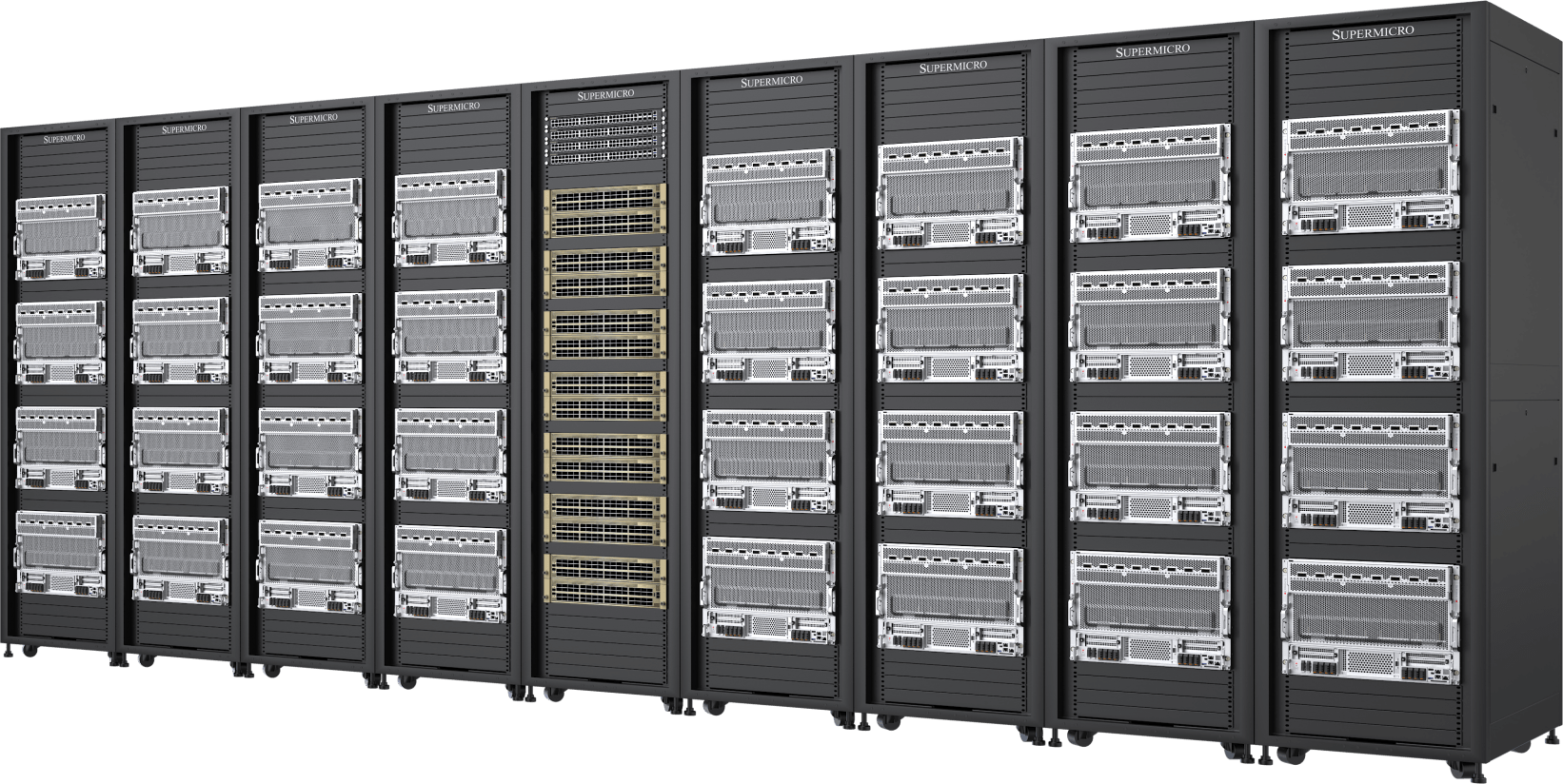

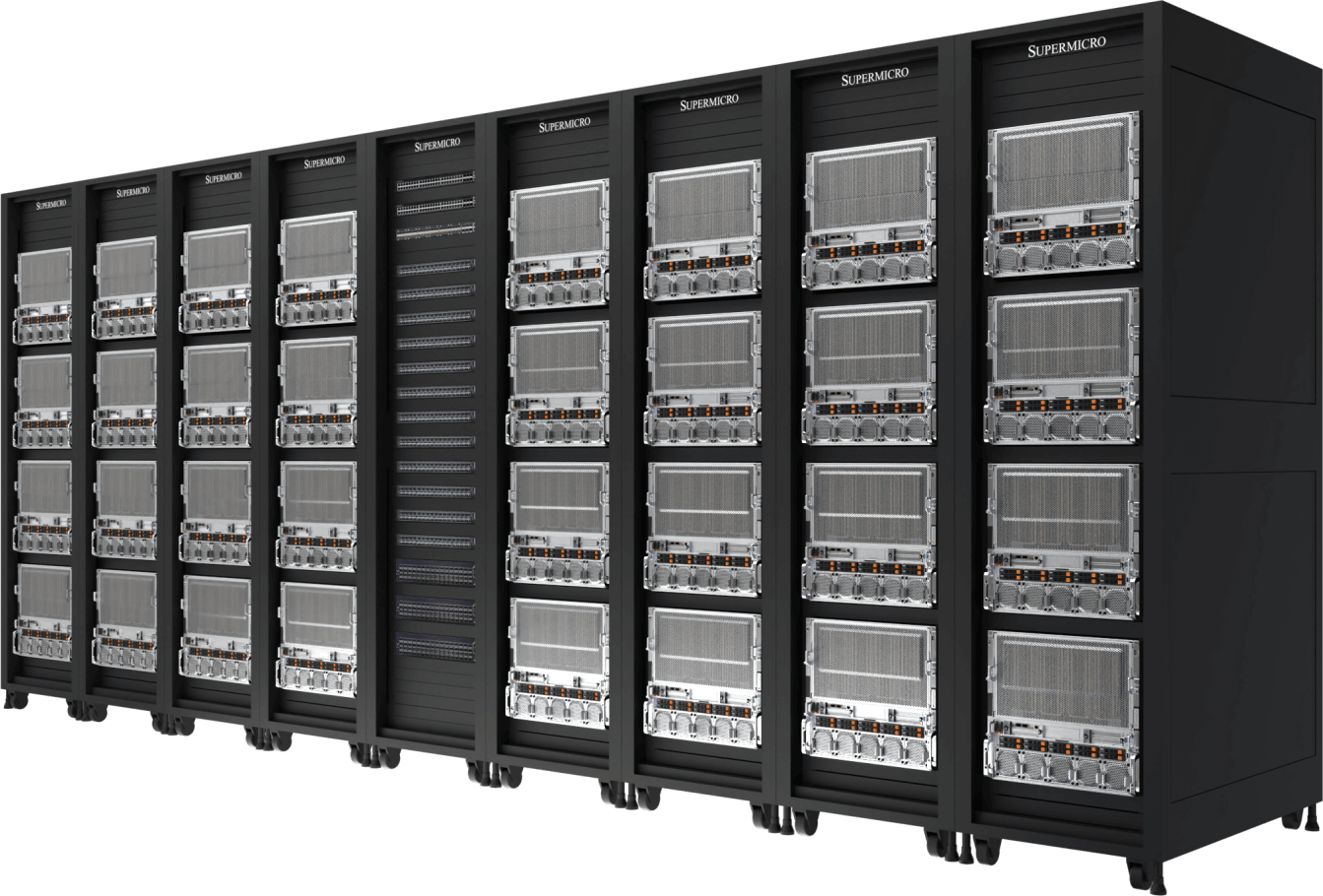

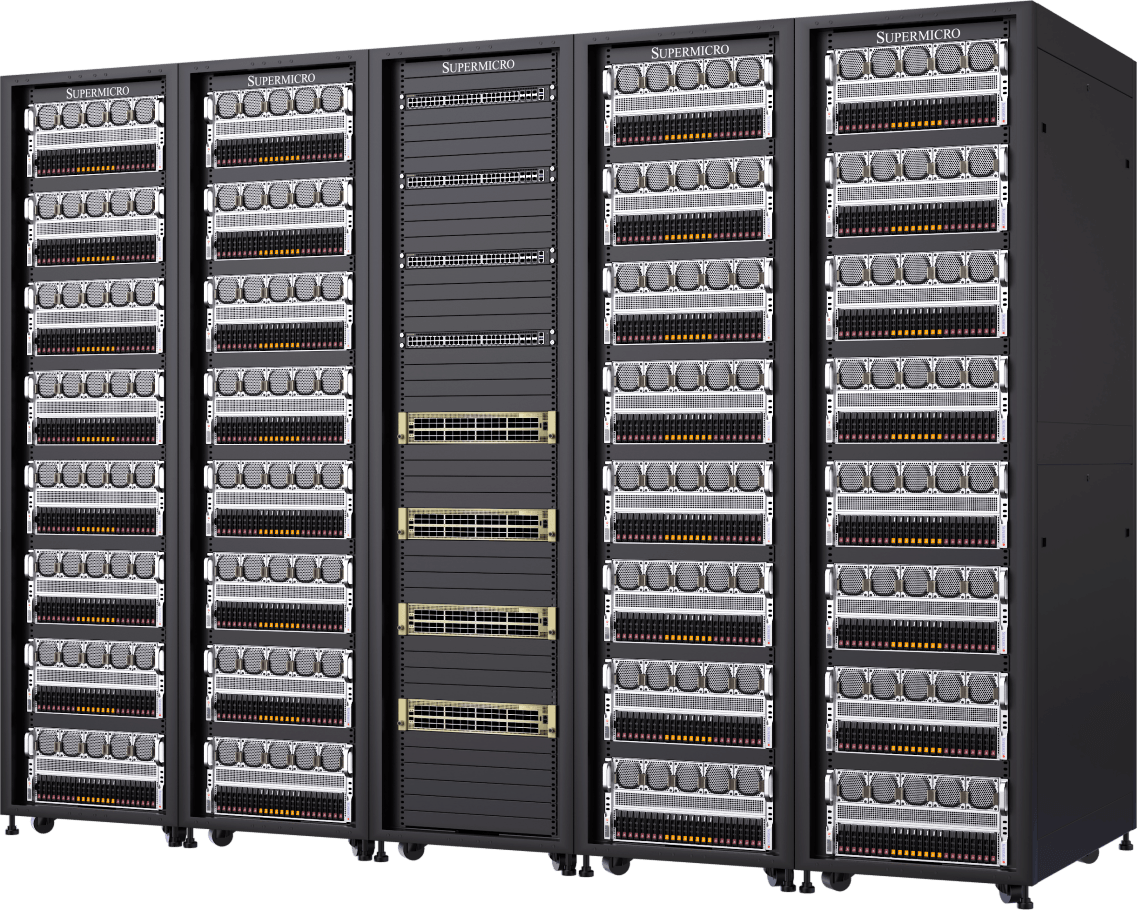

Im Zeitalter der KI wird eine Recheneinheit nicht mehr nur an der Anzahl der Server gemessen. Verbundene GPUs, CPUs, Arbeitsspeicher, Speicher und diese Ressourcen über mehrere Knoten in Racks bilden die heutige Künstliche Intelligenz. Die Infrastruktur erfordert Hochgeschwindigkeits- und latenzarme Netzwerk-Fabrics sowie sorgfältig konzipierte Kühltechnologien und Stromversorgung, um optimale Leistung und Effizienz für jede Rechenzentrumsumgebung aufrechtzuerhalten. Die SuperCluster-Lösung von Supermicro bietet End-to-End-KI-Rechenzentrumslösungen für sich schnell entwickelnde Generative KI und Large Language Models (LLMs).

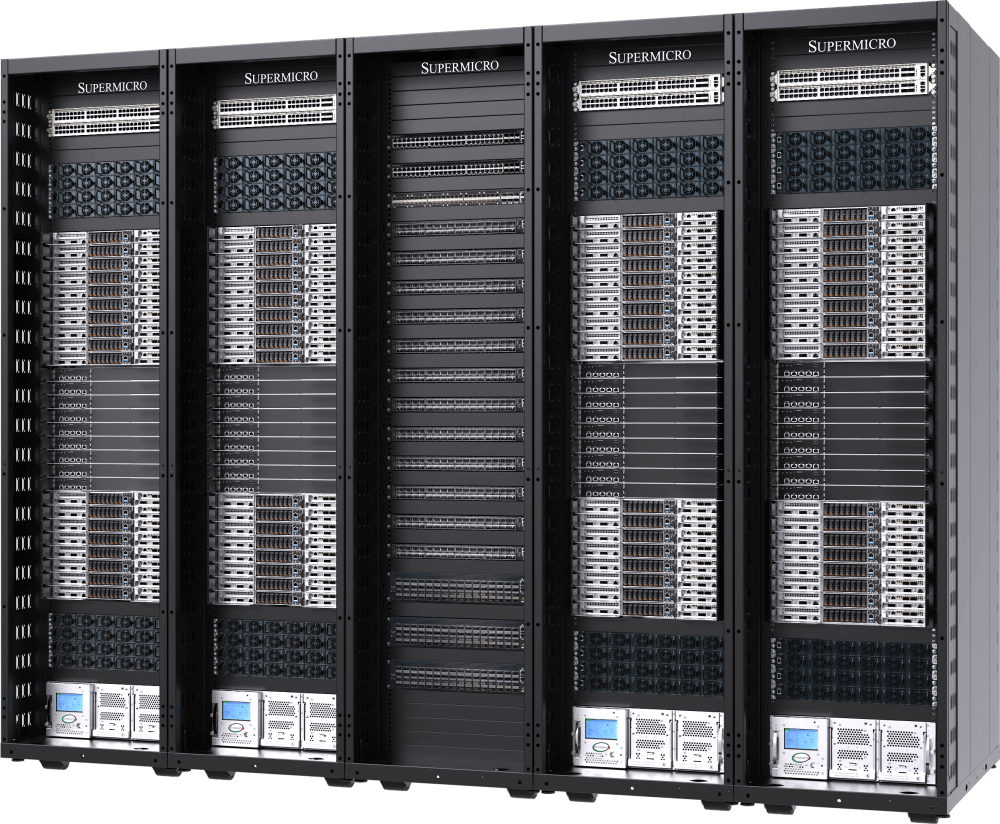

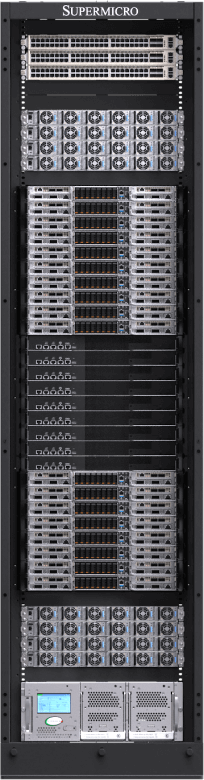

Vollständige Integration in großem Maßstab

Entwurf und Bau von kompletten Racks und Clustern mit einer weltweiten Fertigungskapazität von bis zu 5,000 Gestelle pro Monat

Testen, Validieren, Bereitstellen mit Vor-Ort-Service

Bewährte L11- und L12-Prüfverfahren validieren die betriebliche Effektivität und Effizienz vor der Auslieferung gründlich

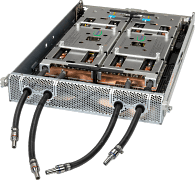

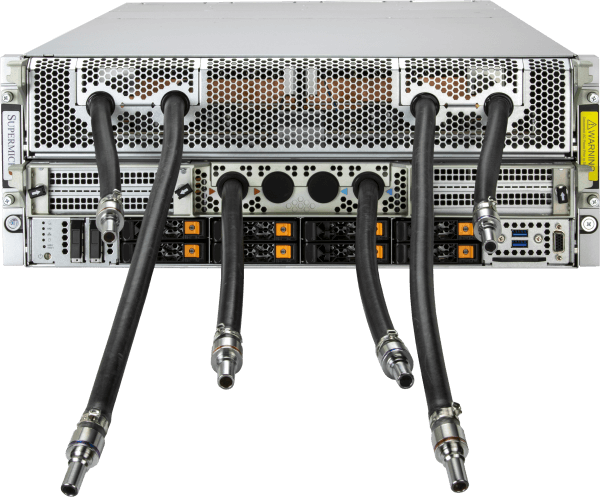

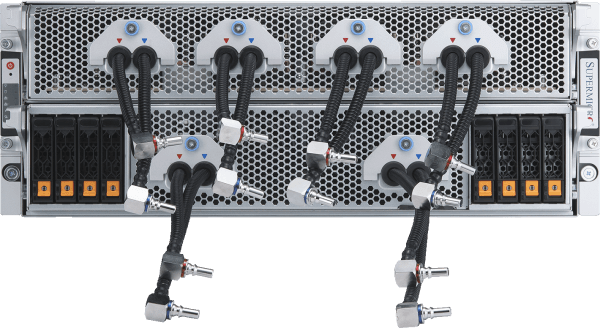

Flüssigkeitskühlung/Luftkühlung

Vollständig integrierte Flüssigkeits- oder Luftkühllösung mit GPU- und CPU-Kühlplatten, Kühlverteilern und Verteilern

Versorgung und Bestandsmanagement

One-Stop-Shop für die schnelle und pünktliche Lieferung vollständig integrierter Racks, um die Zeit bis zur Lösung zu verkürzen und eine schnelle Bereitstellung zu ermöglichen

Die schlüsselfertige Rechenzentrumslösung beschleunigt die Zeit bis zur Bereitstellung für geschäftskritische Unternehmensanwendungen und beseitigt die Komplexität des Aufbaus eines großen Clusters, die bisher nur durch intensive Designabstimmung und zeitaufwändige Optimierung des Supercomputing erreicht werden konnte.

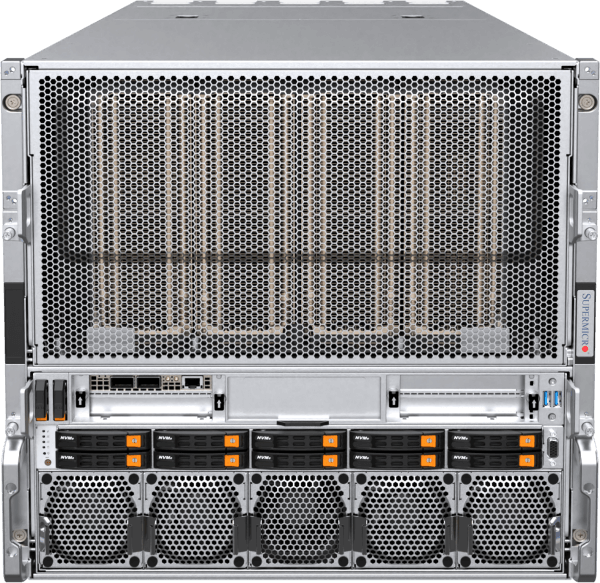

Flüssigkeitsgekühlter 2-HE -NVIDIA-HGX KI

Vollständig integrierter, flüssigkeitsgekühlter Cluster mit 144 Knoten und bis zu 1152 NVIDIA B300-GPUs

- Unübertroffene KI dank NVIDIA HGX B300 mit kompakten 2-OU-Systemknoten mit Flüssigkeitskühlung

- Supermicro Direct Liquid Cooling mit 1,8 MW Kapazität In-Row CDUs (In-Rack-CDU-Optionen verfügbar)

- Große HBM3e-GPU-Speicherkapazität (288 GB* HBM3e-Speicher pro GPU) und Systemspeicherbedarf für das Training von Basismodellen

- Skalierbarkeit mit NVIDIA Quantum-X800 InfiniBand für KI ultra und hoher Bandbreite

- Spezielle Speicher-Fabric-Optionen mit vollständiger Unterstützung für NVIDIA GPUDirect RDMA und Storage oder RoCE

- Entwickelt für die vollständige Unterstützung von NVIDIA KI , einschließlich NVIDIA KI und NVIDIA Run:KI

Rechenknoten

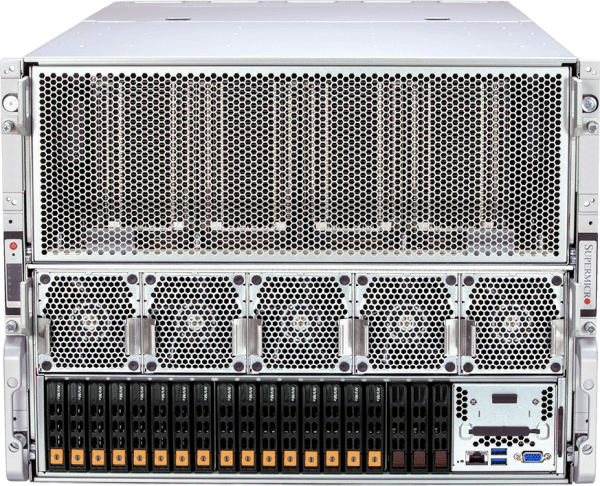

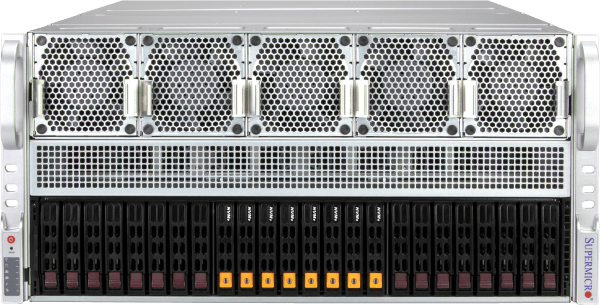

Flüssigkeitsgekühlter 4U NVIDIA HGX B300 KI

Vollständig integrierter, flüssigkeitsgekühlter Cluster mit 72 Knoten und bis zu 576 NVIDIA B300-GPUs

- Setzen Sie leistungsstarkes KI und KI-Inferenz mit NVIDIA HGX B300 ein, das für Rechendichte und Wartungsfreundlichkeit optimiert ist.

- Supermicro Direkte Flüssigkeitskühlung, entwickelt für den dauerhaften Hochleistungsbetrieb und verbesserte Energieeffizienz.

- Große HBM3e-GPU-Speicherkapazität (288 GB* HBM3e-Speicher pro GPU) und Systemspeicherbedarf für das Training von Basismodellen

- Skalierung mit NVIDIA Spectrum™-X Ethernet oder NVIDIA Quantum-X800 InfiniBand

- Spezielle Speicher-Fabric-Optionen mit vollständiger Unterstützung für NVIDIA GPUDirect RDMA und Storage oder RoCE

- Entwickelt für die vollständige Unterstützung von NVIDIA KI , einschließlich NVIDIA KI und NVIDIA Run:KI

Rechenknoten

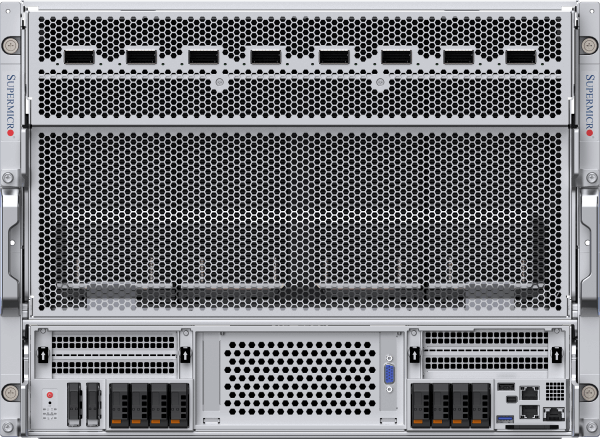

Luftgekühlter 8U NVIDIA HGX B300 KI

Vollständig integrierter, luftgekühlter 32-Knoten-Cluster mit bis zu 256 NVIDIA HGX B300-GPUs und insgesamt 73,7 TB HBM3e-Speicher

- Full-Stack-Lösungen auf Basis von Referenzarchitekturen, einschließlich Supermicro , NVIDIA-GPUs, NVIDIA-Software und NVIDIA-Netzwerktechnologie

- Bis zu 256 NVIDIA HGX B300-GPUs mit insgesamt bis zu 73,7 TB HBM3e-Speicher (288 GB HBM3e pro GPU*)

- Kompatibilität mit dem NVIDIA-Software-Stack (NVIDIA KI und NVIDIA Run:KI)

- Plug-and-Play-Lösung mit Systemen, die vollständig in Racks integriert und vor dem Versand sowie vor der Inbetriebnahme vor Ort getestet werden

- Skalierung mit NVIDIA Spectrum-X Ethernet Compute Fabric oder NVIDIA Quantum-X800 InfiniBand; integriertes konvergentes Netzwerk und Out-of-Band-Management

- KI von NVIDIA empfohlenen Supermicro KI für die Infrastrukturkonfiguration, Spectrum-X -Netzwerke und den Software-Referenzstack auf Basis der NVIDIA Enterprise-Referenzarchitektur für HGX B300

Rechenknoten

Flüssigkeitsgekühlter NVIDIA HGX B200 KI

Mit bis zu 32 NVIDIA HGX B200 8-GPU, 4U flüssigkeitsgekühlte Systeme (256 GPUs) in 5 Racks

- Nutzen Sie die Spitzenleistung im Bereich KI und -Inferenz mit 256 NVIDIA B200-GPUs in einer skalierbaren Einheit (5 Racks).

- Supermicro Direct Liquid Cooling mit einer 250 kW In-Rack Coolant Distribution Unit (CDU), redundanter PSU und zwei Hot-Swap-Pumpen

- 45 TB HBM3e-Speicher in einer skalierbaren Einheit

- Skalierbarkeit mit 400 Gb/s NVIDIA Spectrum-X Ethernet oder NVIDIA Quantum-2 InfiniBand

- Spezielle Speicher-Fabric-Optionen mit vollständiger Unterstützung für NVIDIA GPUDirect RDMA und Storage oder RoCE

- Entwickelt für die vollständige Unterstützung von NVIDIA KI , einschließlich NVIDIA KI und NVIDIA Run:KI

Rechenknoten

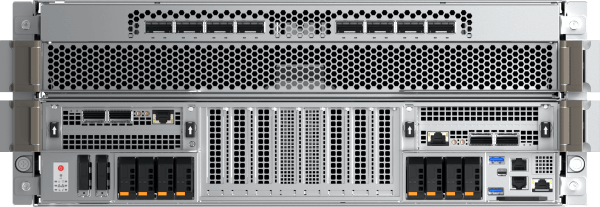

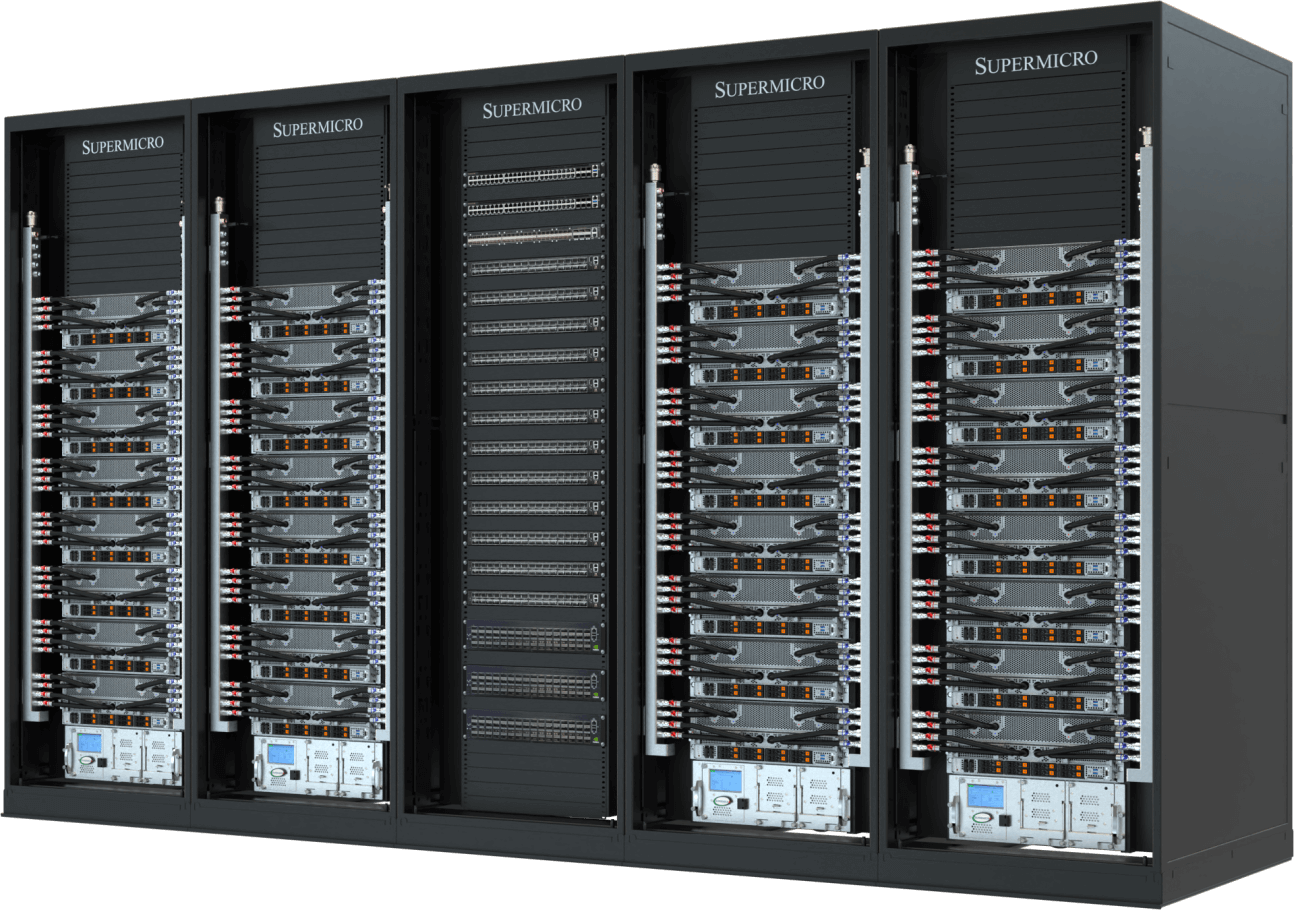

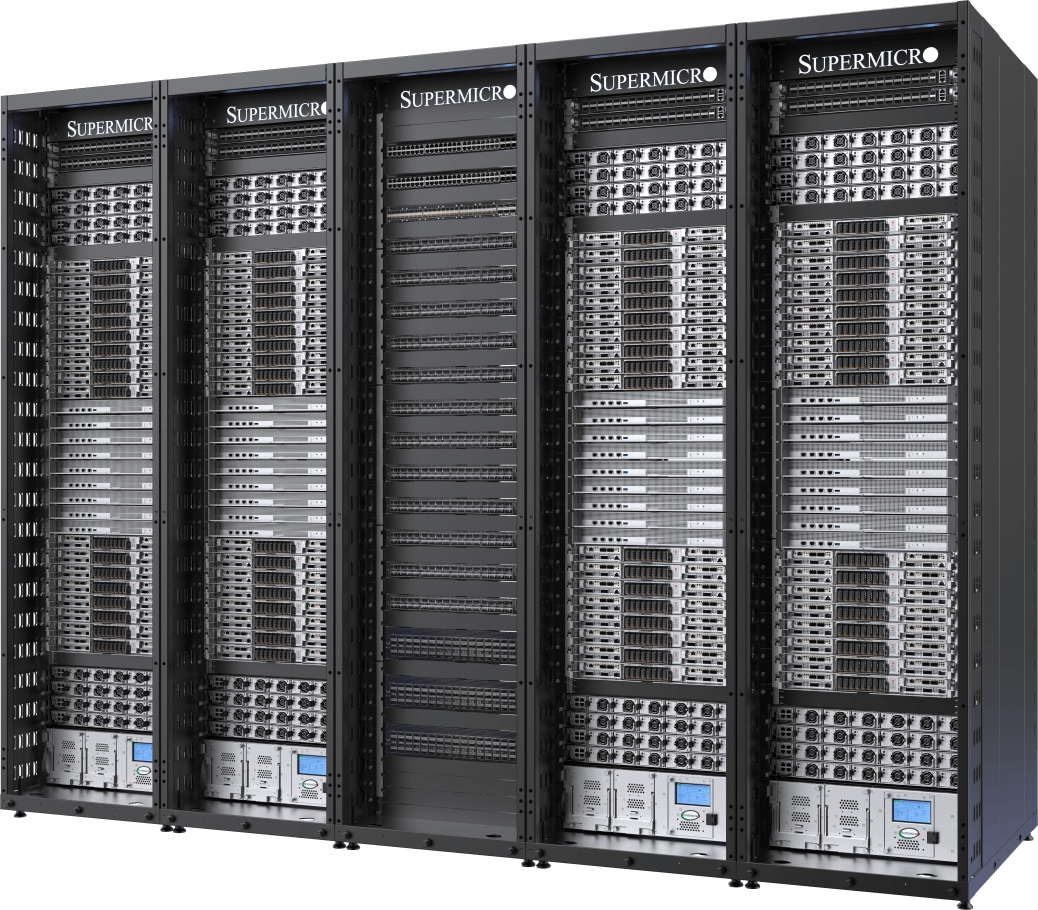

Luftgekühlter NVIDIA HGX B200 KI

Mit 32 NVIDIA HGX B200 8-GPU, 10U luftgekühlte Systeme (256 GPUs) in 9 Racks

- Bewährte, branchenführende Architektur mit neuer, thermisch optimierter, luftgekühlter Systemplattform

- 45 TB HBM3e-Speicher in einer skalierbaren Einheit

- Skalierbarkeit mit 400 Gb/s NVIDIA Spectrum-X Ethernet oder NVIDIA Quantum-2 InfiniBand

- Spezielle Speicher-Fabric-Optionen mit vollständiger Unterstützung für NVIDIA GPUDirect RDMA und Storage oder RoCE

- NVIDIA-zertifizierte Systemknoten, die NVIDIA KI vollständig unterstützen, darunter NVIDIA KI und NVIDIA Run:KI

Rechenknoten

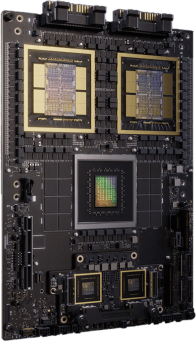

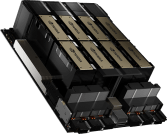

NVIDIA GB300 NVL72

Flüssigkeitsgekühlter Exascale-Rechner in einem einzigen Rack

- Rack-Scale-Lösung mit dem NVIDIA GB300 Grace™ Blackwell Superchip, der 72 NVIDIA B300-GPUs und 36 Grace-CPUs pro Rack bereitstellt

- NVIDIA Blackwell Ultra 288 GB HBM3e pro GPU

- Direkte Flüssigkeitskühlung für bis zu 40 % geringere Stromkosten im Rechenzentrum

- Umfassender Service von der Beratung bis zur vollständigen Implementierung, einschließlich aller erforderlichen Komponenten, Netzwerklösungen und Installationsdienstleistungen vor Ort

- Skalierbarkeit mit 400 Gb/s NVIDIA Spectrum-X Ethernet oder NVIDIA Quantum-2 InfiniBand

- Bis zu 800 Gb/s NVIDIA Quantum-2 InfiniBand oder Spectrum-X Ethernet mit integrierten NVIDIA ConnectX®-8 SuperNICs

Rack-Lösung

NVIDIA GB200 NVL72

Flüssigkeitsgekühlter Exascale-Rechner in einem einzigen Rack

- 72 NVIDIA Blackwell B200-GPUs, die als eine GPU mit einem riesigen Pool an HBM3e-Speicher (13,5 TB pro Rack) fungieren

- 9x NVLink-Switch, 4 Ports pro Rechenfach, der 72 GPUs verbindet, um eine GPU-zu-GPU-Verbindung mit 1,8 TB/s bereitzustellen

- Supermicro Direct Liquid Cooling mit einer 250 kW In-Rack Coolant Distribution Unit (CDU), redundanter PSU und zwei Hot-Swap-Pumpen

- Spezielle Speicher-Fabric-Optionen mit vollständiger Unterstützung für NVIDIA GPUDirect RDMA und Storage oder RoCE

- Skalierbarkeit mit 400 Gb/s NVIDIA Spectrum-X Ethernet oder NVIDIA Quantum-2 InfiniBand

- Entwickelt für die vollständige Unterstützung von NVIDIA KI , einschließlich NVIDIA KI und NVIDIA Run:KI

Rack-Lösung

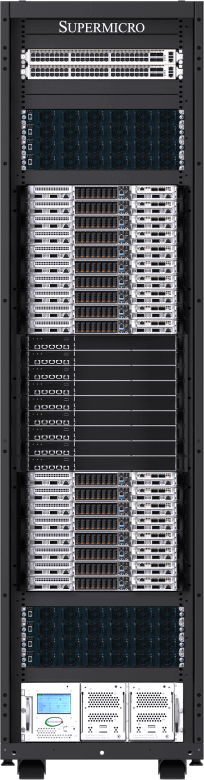

NVIDIA RTX PRO™ SuperCluster

KI -Lösungen mit NVIDIA RTX PRO 6000 Blackwell Server Edition

- Full-Stack-Lösungen auf Basis von Referenzarchitekturen, einschließlich Supermicro , NVIDIA-GPUs, NVIDIA-Software und NVIDIA-Netzwerktechnologie

- Bis zu 256 NVIDIA RTX PRO 6000 Blackwell Server Edition-GPUs mit bis zu 24 TB GDDR7-Speicher

- Kompatibilität mit dem NVIDIA-Software-Stack (NVIDIA KI , NVIDIA Omniverse und NVIDIA Run:KI)

- Plug-and-Play-Lösung mit Systemen, die vollständig in Racks integriert und vor dem Versand sowie vor der Inbetriebnahme vor Ort getestet werden

- NVIDIA Spectrum-X Ethernet-Compute-Fabric, konvergentes Netzwerk und Out-of-Band-Management sind enthalten

- Von NVIDIA empfohlene Supermicro KI für Infrastrukturkonfiguration, Spectrum-X -Netzwerke und Software-Referenzstacks auf Basis der NVIDIA Enterprise Reference Architecture für RTX PRO 6000 Blackwell Server Edition

Rechenknoten

Führender flüssigkeitsgekühlter KI

Mit 32 flüssigkeitsgekühlten NVIDIA HGX H200-Systemen mit 8 GPUs (256 GPUs) in 5 Racks

- Verdoppelung der Rechenleistungsdichte durch Supermicros kundenspezifische Flüssigkeitskühlungslösung mit bis zu 40 % Reduzierung der Stromkosten für Rechenzentren.

- 256 NVIDIA H200-GPUs in einer skalierbaren Einheit

- 36 TB HBM3e mit H200 in einer skalierbaren Einheit

- Spezielle Speicher-Fabric-Optionen mit vollständiger Unterstützung für NVIDIA GPUDirect RDMA und Storage oder RoCE

- Skalierbarkeit mit 400 Gb/s NVIDIA Spectrum-X Ethernet oder NVIDIA Quantum-2 InfiniBand

- NVIDIA-zertifizierte Systemknoten, die NVIDIA KI vollständig unterstützen, darunter NVIDIA KI und NVIDIA Run:KI

Rechenknoten

Bewährtes Design

Mit 32 luftgekühlten NVIDIA HGX H200-Systemen mit 8 GPUs (8U) (insgesamt 256 GPUs) in 9 Racks

- Bewährte, branchenführende Architektur für den Einsatz von KI in großem Maßstab

- 256 NVIDIA H200-GPUs in einer skalierbaren Einheit

- 36 TB HBM3e mit H200 in einer skalierbaren Einheit

- Skalierbarkeit mit 400 Gb/s NVIDIA Spectrum-X Ethernet oder NVIDIA Quantum-2 InfiniBand

- Anpassbare KI -Speicherstruktur mit branchenführenden parallelen Dateisystemoptionen

- NVIDIA-zertifizierte Systemknoten, die NVIDIA KI vollständig unterstützen, darunter NVIDIA KI und NVIDIA Run:KI

Rechenknoten