本能™ MI350 系列/MI325X

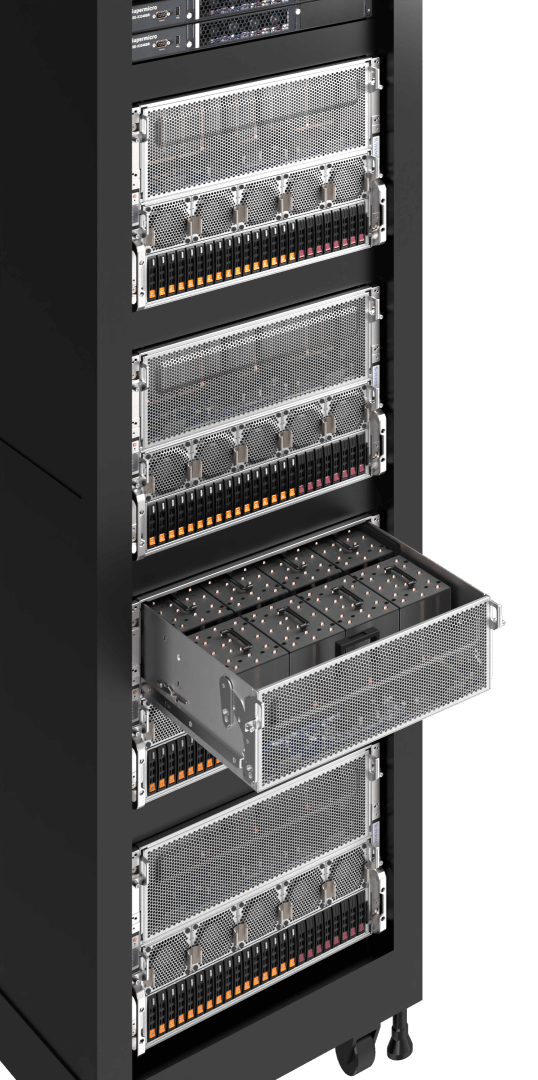

Supermicro 推出一款服务器,采用我们成熟的 AI 积木式系统构建,释放了大规模基础设施的强大潜力,并由第五代 AMD EPYC™ 处理器和 AMD Instinct™ MI350 系列 GPU 驱动。这是一款基于行业标准的通用基板 (UBB 2.0) 模型,配备 8 个 AMD Instinct MI350 系列加速器和超过 2 TB 的 HBM3e 内存,以帮助处理最严苛的 AI 模型。

资源

MI325X 风冷和水冷系统

- MI350P

风冷式 - MI355X

风冷版 - MI350X,

MI325X

风冷式 - MI355X,

MI325X

液冷式

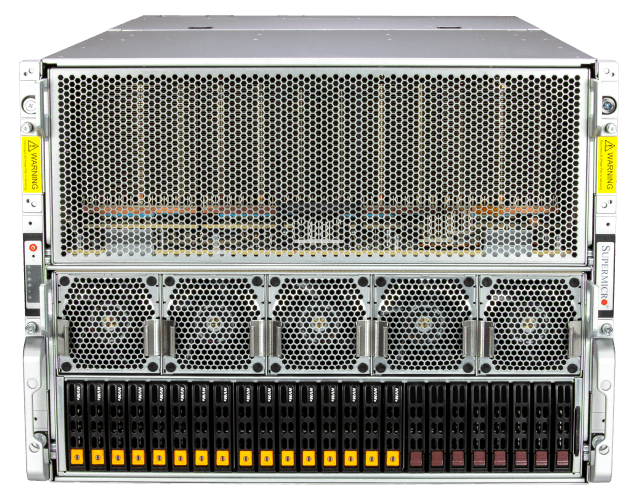

配备 AMD Instinct MI350P 的 DP AMD 5U 系统

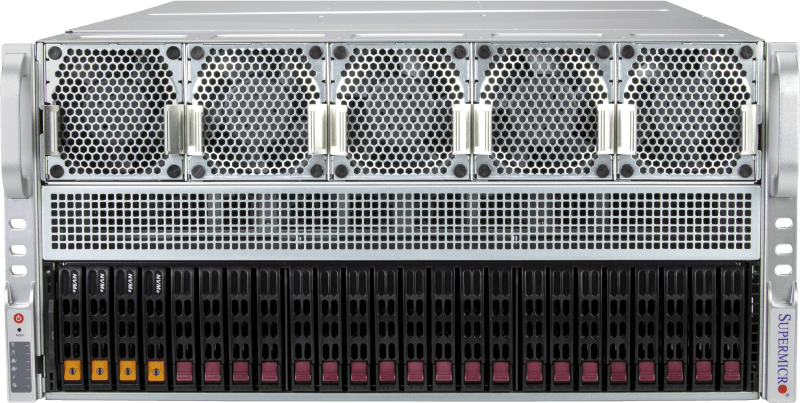

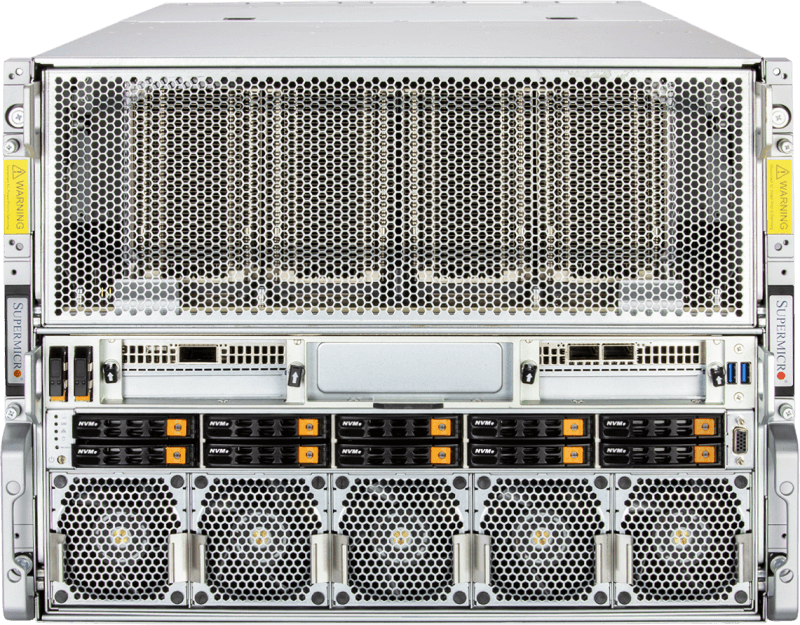

DP AMD 10U 系统,配备 AMD Instinct 8-GPU

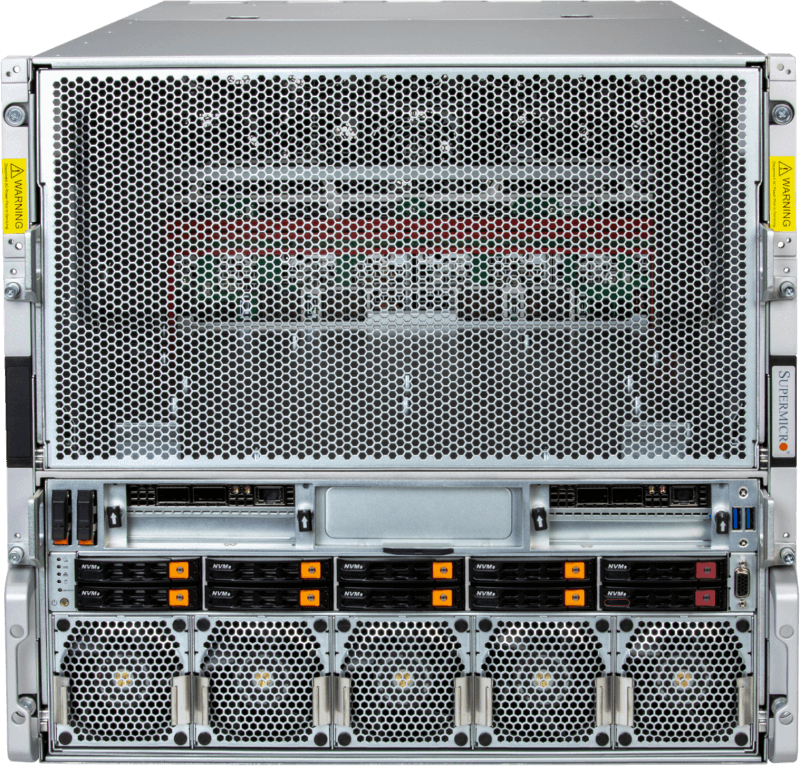

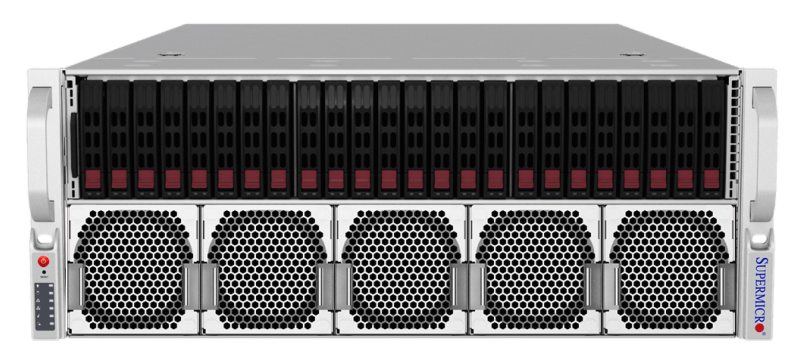

配备AMD Instinct 8 图形处理器的 DPAMD 8U系统

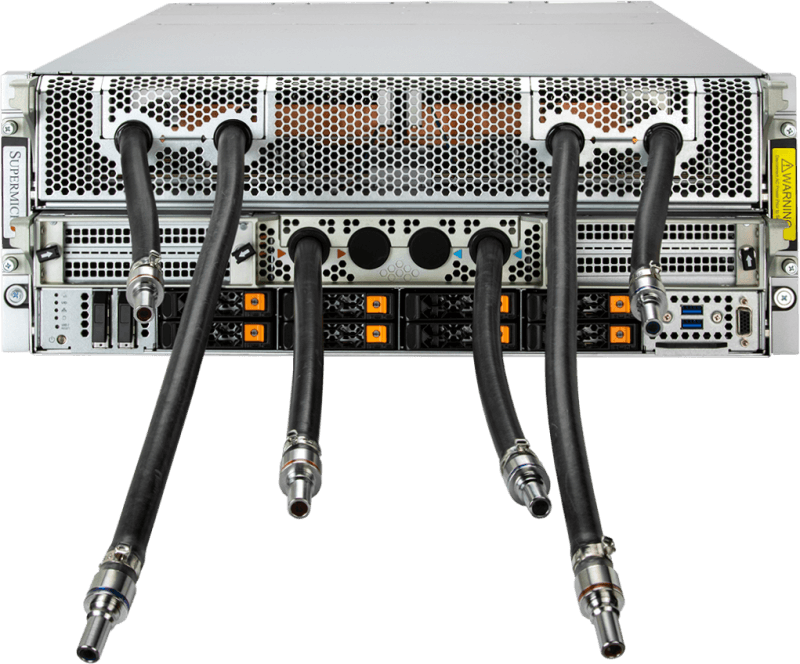

配备AMD Instinct8图形处理器和液冷系统的 DPAMD 4U 系统

本能™ MI300X/A

MI300X 8-GPU 系统采用AMD Infinity Fabric™链接,可在开放标准平台上实现高达896 GB/s的峰值理论 P2P I/O 带宽,在单个服务器节点中拥有业界领先的1.5 TBHBM3 GPU 内存,并支持原生稀疏矩阵,旨在为人工智能工作负载节省功耗、降低计算周期并减少内存使用。

针对 HPC 和 AI 推理进行数据中心优化的多处理器系统。Supermicro 的风冷 4U 和液冷 2U 四 APU 系统支持 AMD Instinct™ MI300A,这些系统结合了 CPU 和 GPU,利用了 Supermicro 在多处理器系统架构和散热设计方面的专业知识,经过精心调优,以应对人工智能和 HPC 的融合。

资源

MI300X/MI300A 风冷和水冷系统

- MI300X

风冷式 - MI300X

液冷 - MI300A

空气冷却 - MI300A

液冷

采用 CPU 到 GPU 互联的 DP 8U4-GPUOAM 架构

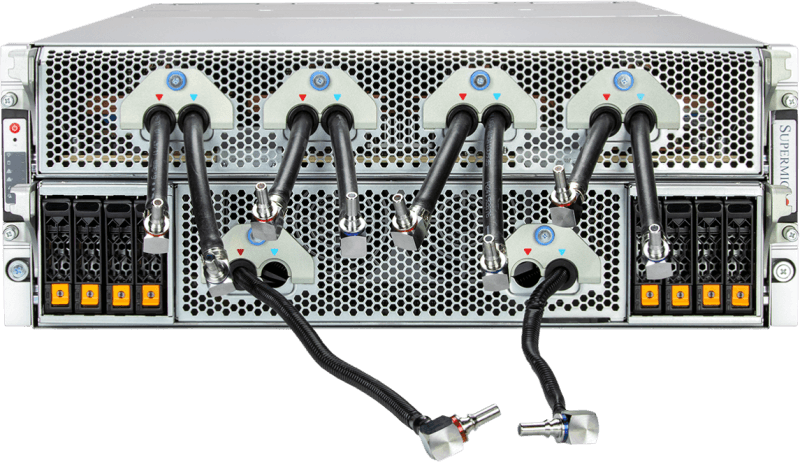

采用液冷解决方案的 DP 4U4-GPUOAM 架构

采用AMD Infinity Fabric™ Link 的 DP 4U4-APU架构

采用液冷解决方案的 DP 2U4-APU结构

资源