人工智能和可视计算的全面灵活性

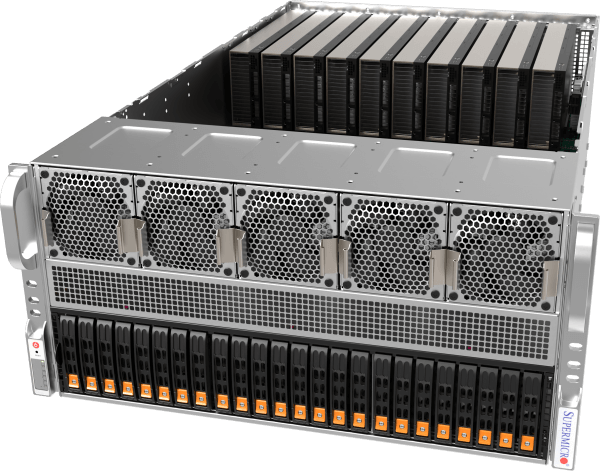

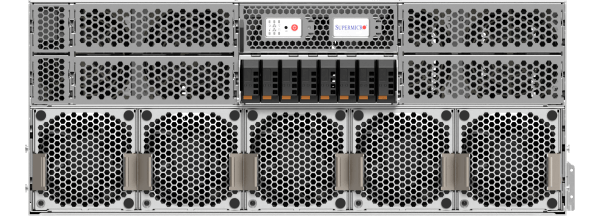

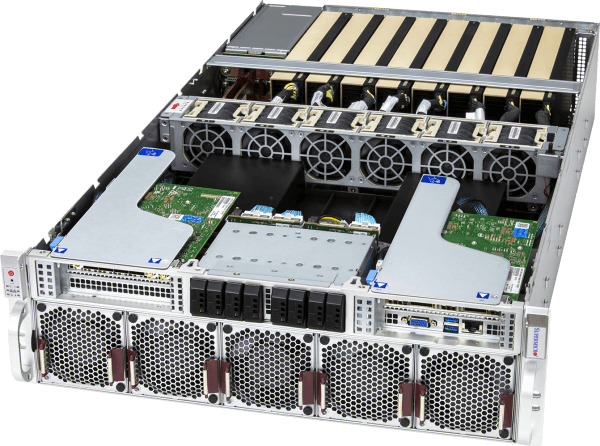

Supermicro 提供广泛的系统,针对最新的 PCIe GPU 进行了优化,非常适合支持 AI 的企业应用,包括全新的 NVIDIA RTX PRO™ 6000 Blackwell 服务器版和 NVIDIA H200 NVL,以提供强大且经济高效的多工作负载加速,适用于大型语言模型 (LLM) 推理和微调、可视化、图形与渲染以及虚拟化。其中包括 NVIDIA 认证系统,这些系统可确保与 NVIDIA AI Enterprise 软件的兼容性和支持,从而简化生产 AI 的开发和部署过程。Supermicro 经过热优化设计的架构可在风冷环境中最大限度地提高性能,并且还设计用于支持 NVIDIA SuperNIC,例如 BlueField®-3 和 ConnectX®7,以实现与 NVIDIA Quantum InfiniBand 和 Spectrum 以太网的最佳基础设施扩展和 GPU 集群。

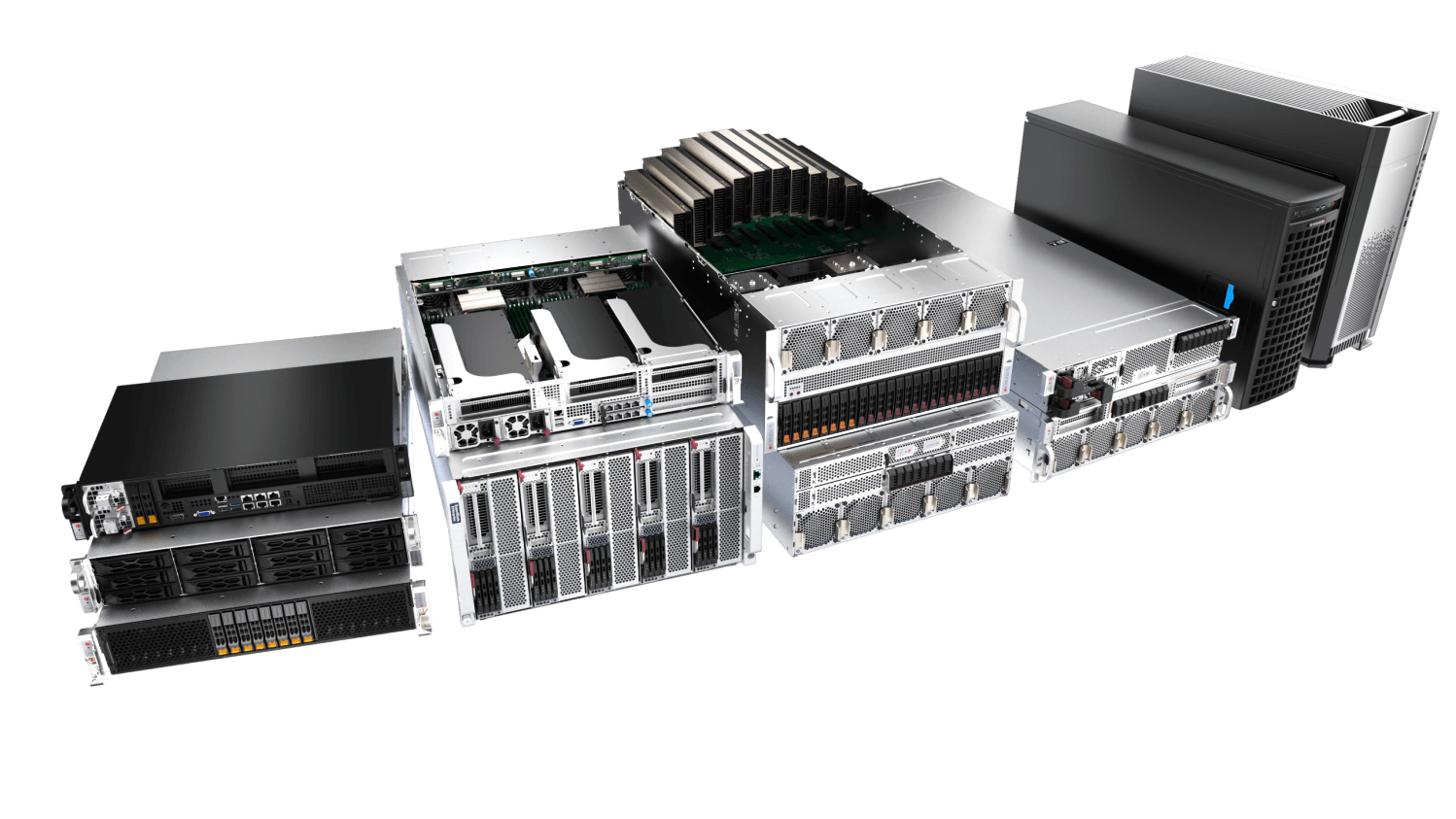

从数据中心到边缘的加速

广泛的外形尺寸产品组合,支持即插即用和热优化架构,可在各种环境中提供强大的加速。从机架级 GPU 优化系统到数据中心机架式服务器和紧凑型边缘系统,Supermicro 提供广泛的系统,以支持任何企业 AI 工作负载。

广泛的工作量支持

高度灵活的系统,几乎适用于任何应用,包括金融服务、零售、云计算、虚拟化和 3D 媒体创建。支持英伟达™(NVIDIA®)多实例 GPU(MIG)的 GPU 允许在一块卡上安装多达四个独立实例,从而提高共享环境中的利用率。

开放、优化的架构

利用行业标准的 PCIe 互连,其设计还能在风冷环境中实现最高散热性能,从而在环境温度较高时也能支持最新、最强大的 GPU 显卡。

携手 Supermicro 系统和 NVIDIA PCIe GPU,释放新可能

多加速器支持从数据中心到边缘的各种工作负载

将 Supermicro 系统与广泛的 NVIDIA PCIe 加速器相匹配,以实现 AI 推理和微调、视觉计算、具身与物理 AI、科学模拟、虚拟化以及媒体与设计的特定工作负载优化

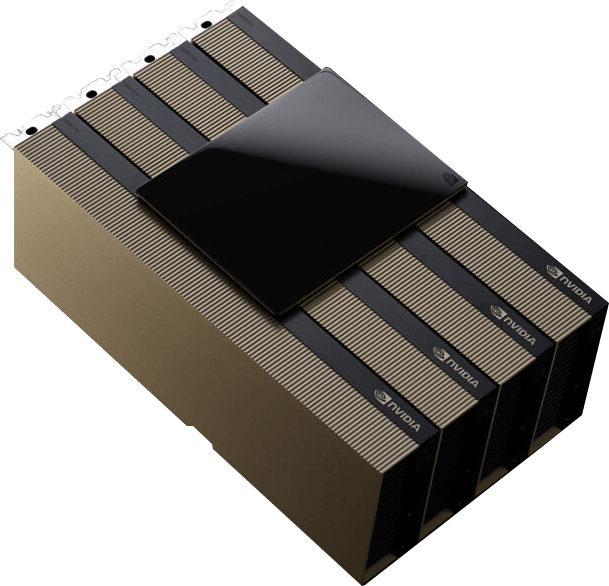

英伟达™(NVIDIA®)RTX PRO™ 6000 Blackwell

生成式人工智能、图形、视频

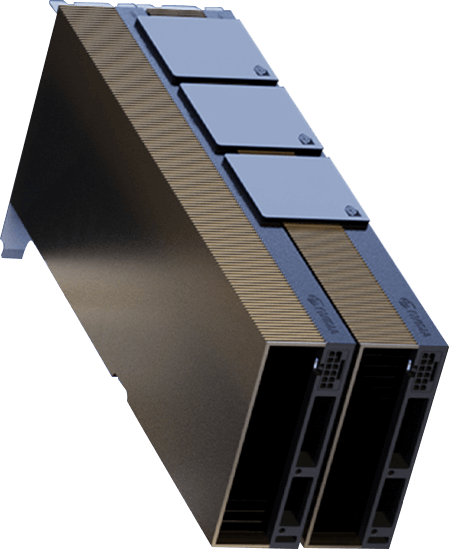

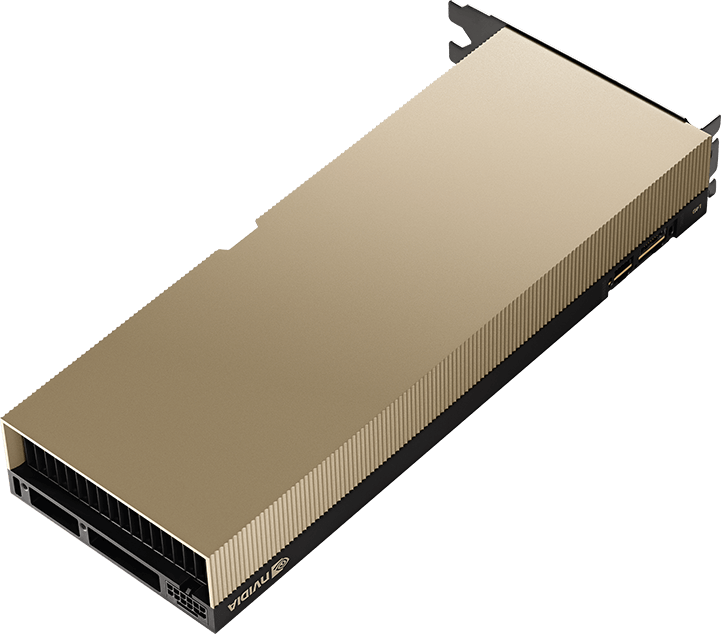

NVIDIA H200 NVL

大型人工智能模型推理与微调, 科学研究, HPC

NVIDIA H100 NVL

人工智能推理与微调, HPC

英伟达 L40s

LLM 推断、渲染和 3D 图形

英伟达 L4

人工智能边缘推理、图形、虚拟化

生成和代理人工智能

英伟达™(NVIDIA®)图形处理器为人工智能、图形和媒体提供多负载加速,是多模式生成式人工智能流水线的首要平台。

LLM 推断和微调

利用强大的吞吐量和浮点性能加速训练、微调和推理工作负载,以构建和部署最先进的人工智能模型。

渲染和 3D 图形

利用英伟达™(NVIDIA®)GPU运行专业的三维可视化应用程序,能够让创意专业人士进行更多的迭代、更快的渲染,并释放出巨大的性能优势,从而提高工作效率并加快项目的完成。

虚拟化

利用英伟达™(NVIDIA®)多实例 GPU(MIG)和时间切片技术,使用单个加速器创建多个 GPU 实例,显著提高虚拟化和云计算环境中的利用率。