NVIDIABlackwell ここから始まります

AIの変革の瞬間が到来しています。進化するスケーリング則とAI推論の台頭により、データセンターの能力は新たな限界値へと押し上げられています。Supermicro の最新 NVIDIA Blackwell 搭載ソリューションは、NVIDIAとの緊密な連携によって開発され、次世代の空冷および液冷アーキテクチャにより、かつてないほどの演算性能、搭載密度、効率性を実現しています。さらに、迅速な導入が可能なAI向けデータセンター・ビルディング・ブロック・ソリューションにより、Supermicro はNVIDIA Blackwell 活用に向けた最高のパートナーであ り、AIイノベーションを加速させる持続可能な最先端ソリューションを提供します。

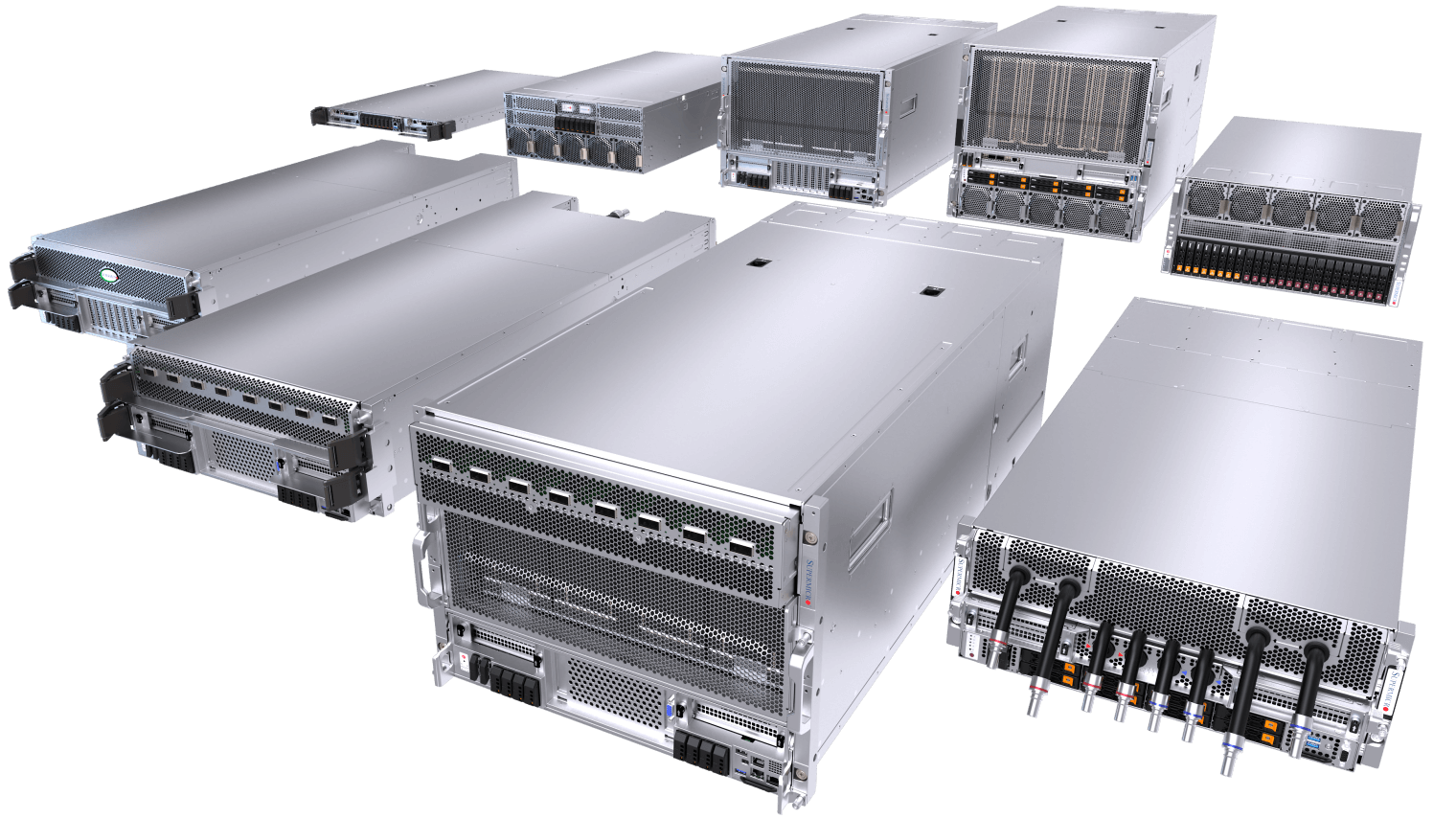

エンド・ツー・エンドのAIデータセンター・ビルディング・ブロック・ソリューションの強み

複数のCPUオプションを備えた幅広い空冷および液冷システム、完全なデータセンター管理ソフトウェアスイート、完全なネットワーク、ケーブル配線、クラスタレベルのL12検証を含むターンキーラックレベルの統合、グローバルな配送、サポート、サービス。

- 豊富な経験

- Supermicroセンター・ビルディングブロック・ソリューションSupermicro、世界最大規模の水冷式AIデータセンターの導入を支えています。

- 柔軟なサービス

- 空冷または液冷、GPU最適化、複数のシステムおよびラックフォームファクター、CPU、ストレージ、ネットワークオプションなど、お客様のニーズに合わせて最適化します。

- 液冷のパイオニア

- AI革命を支える、実績があり、拡張性が高く、すぐに使える水冷ソリューションです。NVIDIABlackwell 向けに特別に設計されています。

- 短期間での導入

- グローバルな生産能力、世界クラスの導入専門知識、オンサイトサービスにより、短期間でのAI導入をサポートします。

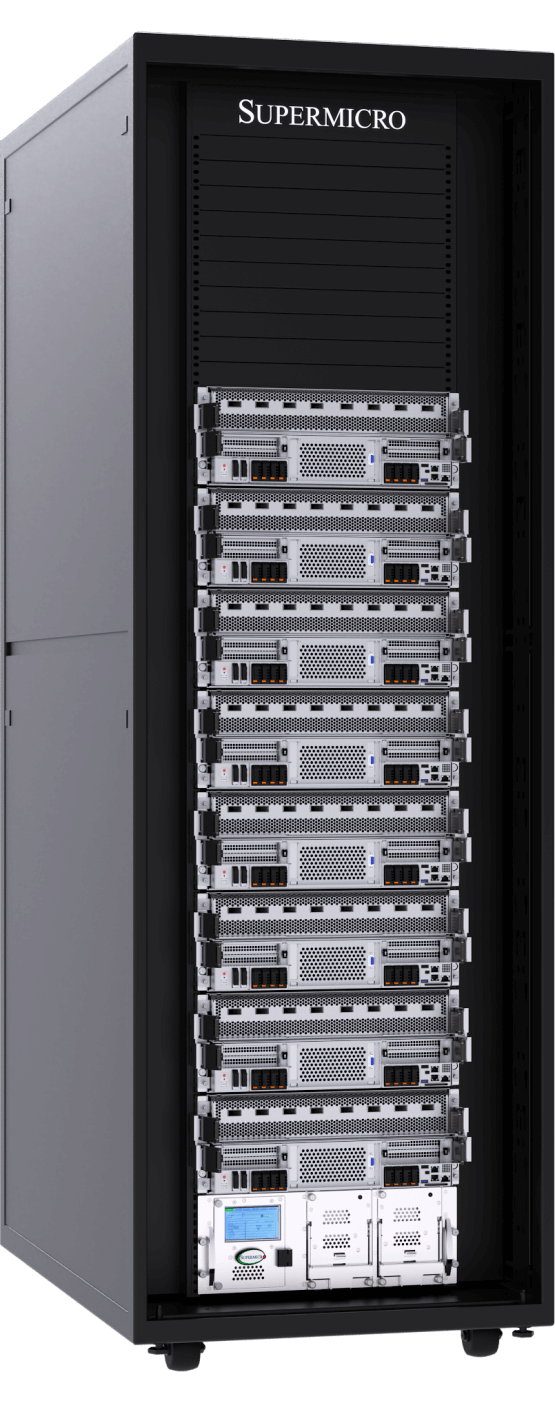

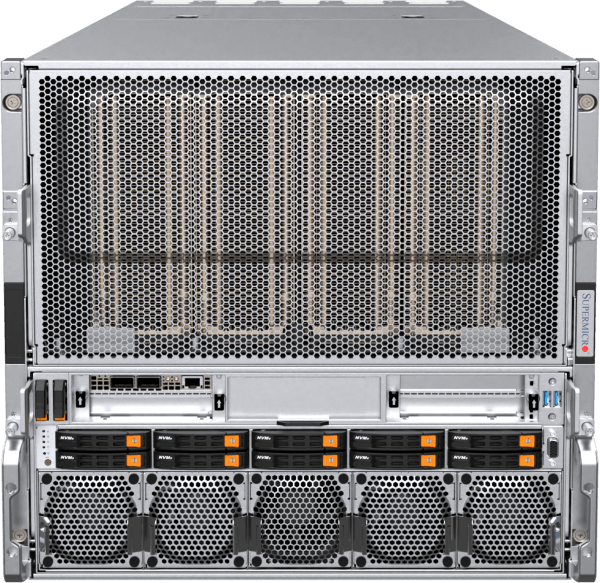

最もコンパクトなハイパースケールAIプラットフォーム

OCP ORV3 設計に最適化された NVIDIAHGX™ システム。1ラックあたり最大144基のGPUを搭載可能です。

Supermicro液体冷却式NVIDIA HGX BSupermicro、ハイパースケール展開において比類のないGPU密度を実現します。OCP ORV3仕様に準拠し、先進的なDLC-2テクノロジーを採用したこのコンパクトな8-GPUノードは、21インチラックに収まり、1ラックあたり最大18ノード、合計144枚のGPUを搭載可能です。 ブラインドメイト・マニホールド接続とモジュラー式のGPU/CPUトレイアーキテクチャを採用した本システムは、各B300 GPUに対し最大1,100WのTDPを維持しつつ、ラックの設置面積、消費電力、および冷却コストを大幅に削減します。卓越した保守性と最大のパフォーマンス密度を必要とするAIファクトリーに最適です。

GPUあたり288 GBのHBM3e

2-OU 液体冷却システム

NVIDIA HGX B300 8GPU用

標準化されたORV3ラックに最大144基のNVIDIABlackwell Ultra を搭載

AI推論のためのUltra

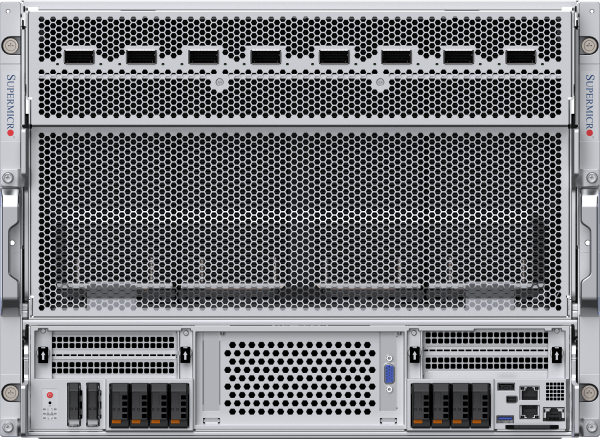

NVIDIAHGX™ 向けの最先端の空冷および水冷アーキテクチャ

SupermicroのNVIDIA HGX プラットフォームは、世界最大級のAIクラスターの多くを支える基盤となっており、今日の革新的なAIアプリケーションに不可欠な膨大な演算能力を提供しています。最新の NVIDIA Blackwell Ultra を搭載する8U 空冷システムは、最大 2.3TB の HBM3e メモリーを搭載する、8 基の1100W TDP NVIDIA HGX B300 GPU の性能を最大限に引き出すように設計されています。前面の8つのOSFP ポートは、800 Gb/s の NVIDIA ConnectX®-8 SuperNICを統合し、NVIDIA Quantum-X800 InfiniBandまたは NVIDIA Spectrum-XTM Ethernet コンピューティングファブリックとのプラグアンドプレイによる導入を可能にします。新しい 4U 液冷システムは、Supermicro の DLC-2テクノロジーを採用しており、最大98%の熱回収を実現し、データセンターの電力消費量を最大40%削減することが可能です。DCBBSとSupermicro の専門知識を持ったオンサイト導入支援の組み合わせによって、液冷テクノロジー、ネットワークトポロジーと配線、電力供給、熱管理を網羅したトータルソリューションを提供し、AIファクトリーのオンライン化を加速します。

4U水冷式または8U空冷式システム

NVIDIA HGX B300 8GPU用

フロントI/O搭載の液体冷却システム(NVIDIAConnectX-8800 Gb/s ネットワーク機能を統合)

NVIDIABlackwell Ultra B300 8-GPU(NVIDIAConnectX-8ネットワーク機能内蔵)用フロントI/O空冷システム

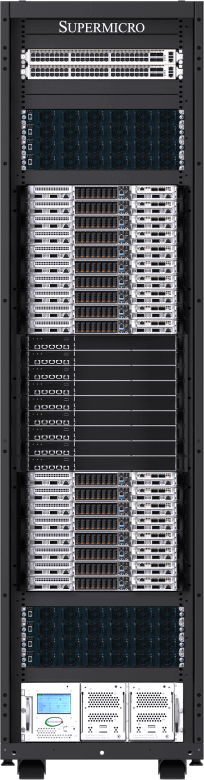

1ラックでエクサスケール・コンピューターを実現

NVIDIA GB300NVL72向けエンドツーエンド水冷ソリューション

Supermicro GB300NVL72 、トレーニング 大規模な推論に至るまで、AIの計算ニーズNVL72 。高いAI性能とSupermicroダイレクト水冷技術を組み合わせることで、最大の計算密度と効率を実現します。NVIDIABlackwell Ultraをベースとし、1つのラックに、メモリー 288GBのHBM3メモリー を搭載した72基のNVIDIA B300 GPUを統合しています。 1.8TB/sのNVLink相互接続を備えたGB300NVL72 、単一ノードでエクサスケール・スーパーコンピュータとしてNVL72 。アップグレードされたネットワークにより、コンピュート・ファブリック全体のパフォーマンスが倍増し、800Gb/sの速度に対応しています。Supermicro製造能力とエンドツーエンドのサービスにより、水冷式AI ファクトリー 加速され、GB300NVL72 市場投入までの時間が短縮されます。

NVIDIA GB300NVL72 GB200NVL72

NVIDIA GB300/GB200 Grace™Blackwell 向け

1つのNVIDIA NVLinkドメイン内に72基のNVIDIABlackwell Ultra 。Ultra とスケーラビリティを実現しました

1つのNVIDIA NVLinkドメイン内に72基のNVIDIABlackwell 。AIコンピューティングアーキテクチャの頂点です。

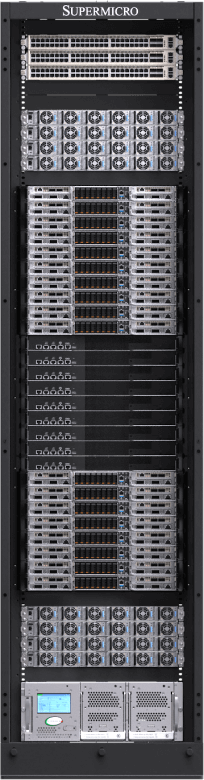

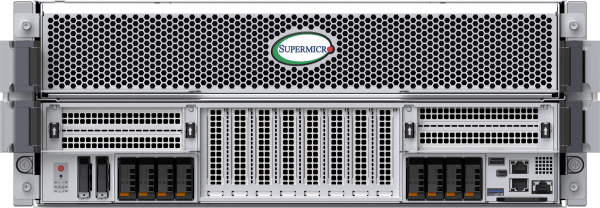

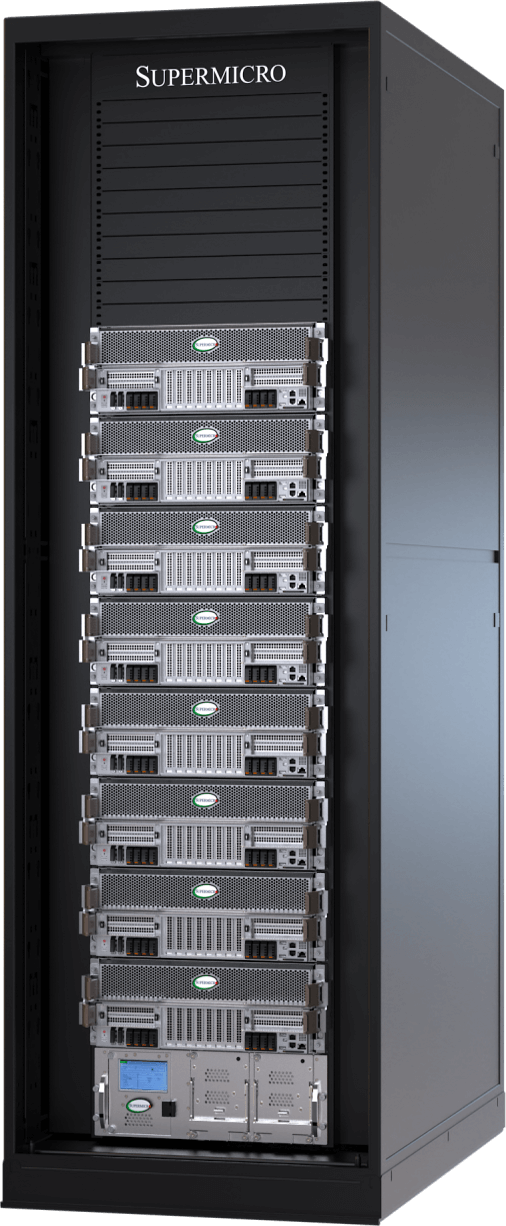

進化した空冷システム

NVIDIA HGX B200 8GPU用に再設計・最適化されたベストセラー空冷システム

新しい空冷式NVIDIA HGX B200 8-GPUシステムは、強化された冷却アーキテクチャ、CPU、メモリー、ストレージ、ネットワークに対する高い構成自由度、および前面または背面からのメンテナンス性の向上を特徴としています。 新しい 8U/10U 空冷システムは、最大 4 台をラックに設置して完全に統合することができ、前世代と同等の密度を実現しながら、最大 15 倍の推論 トレーニング 推論 3 倍のトレーニング を提供します。 すべてのSupermicro HGX B200 システムには、1:1 の GPU-to-NIC 比が採用されており、NVIDIABlueField®-3または NVIDIAConnectX®-7をサポートすることで、ハイパフォーマンス ・ファブリック全体でのスケーリングを実現します。

8UフロントI/Oまたは10UリアI/O空冷システム

NVIDIA HGX B2008GPU用

フロントI/O空冷システムで、システムメモリー 柔軟性が向上し、コールドアイルでのメンテナンス性が向上しています

大規模言語モデルのトレーニング 高負荷の推論向けに、リアI/O方式の空冷設計を採用しています

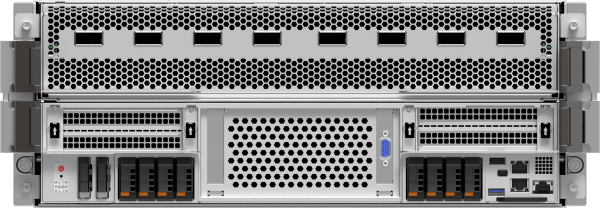

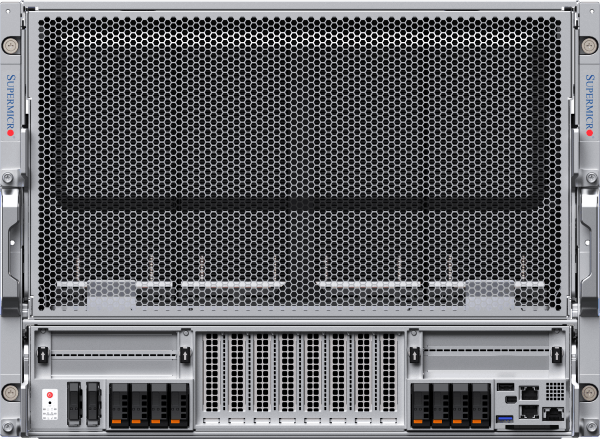

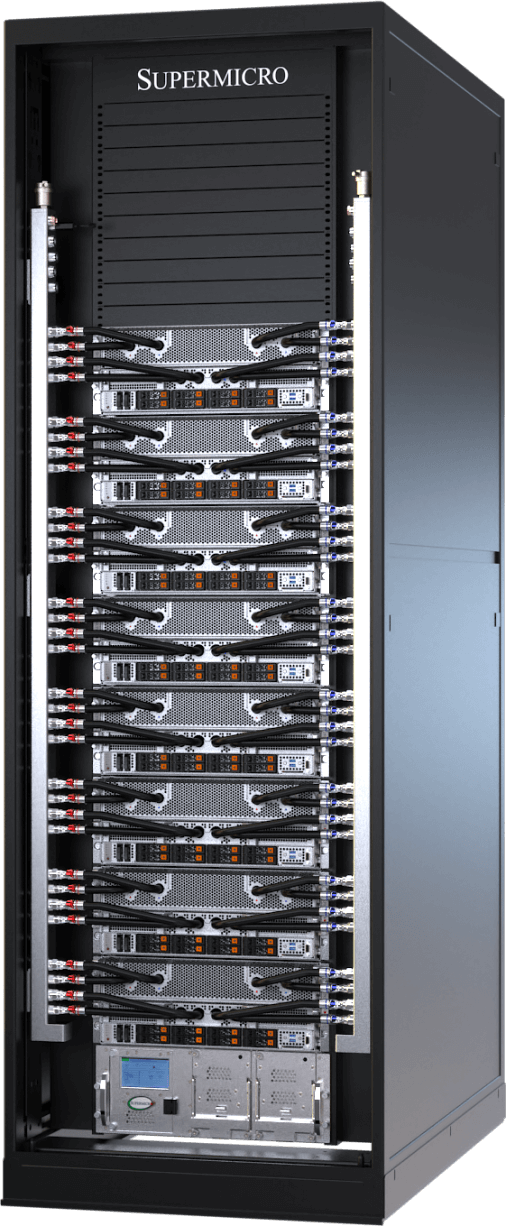

次世代液冷システム

最大96基のNVIDIA HGX™ B200 GPUを1つのラックに搭載し、最高のスケーラビリティと効率性を実現

新しいフロントI/O搭載の水冷式4U NVIDIA HGX B2008-GPUシステムは、Supermicroテクノロジーを採用しています。ダイレクト・リキッド・クーリングにより、CPU、GPU、PCIe 、DIMM、VRM、PSUなどのサーバーコンポーネントから発生する熱の最大92%を吸収し、データセンターの電力消費を最大40%削減するとともに、騒音レベルを50dBまで低減します。 この新しいアーキテクチャは、NVIDIA HGX H100/H2008-GPUシステム向けに設計された前世代モデルと比較して、効率性と保守性をさらに向上させています。 42U、48U、または52Uの構成で提供されるこのラックスケール設計では、新しい垂直型冷却液分配マニホールド(CDM)を採用しているため、水平型マニホールドが貴重なラックユニットを占有することがなくなりました。これにより、42UラックにNVIDIABlackwell 64基搭載したシステムを8台、52UラックにはNVIDIA GPUを96基搭載したシステムを最大12台収容することが可能になります。

4UフロントI/OまたはリアI/O液冷システム

NVIDIA HGX B2008GPU用

フロントI/O DLC-2液冷システム、データセンターの電力を最大40%節約、ノイズレベルは50dBまで低減

最大の計算密度とパフォーマンスを実現するために設計されたリアI/O液冷システム

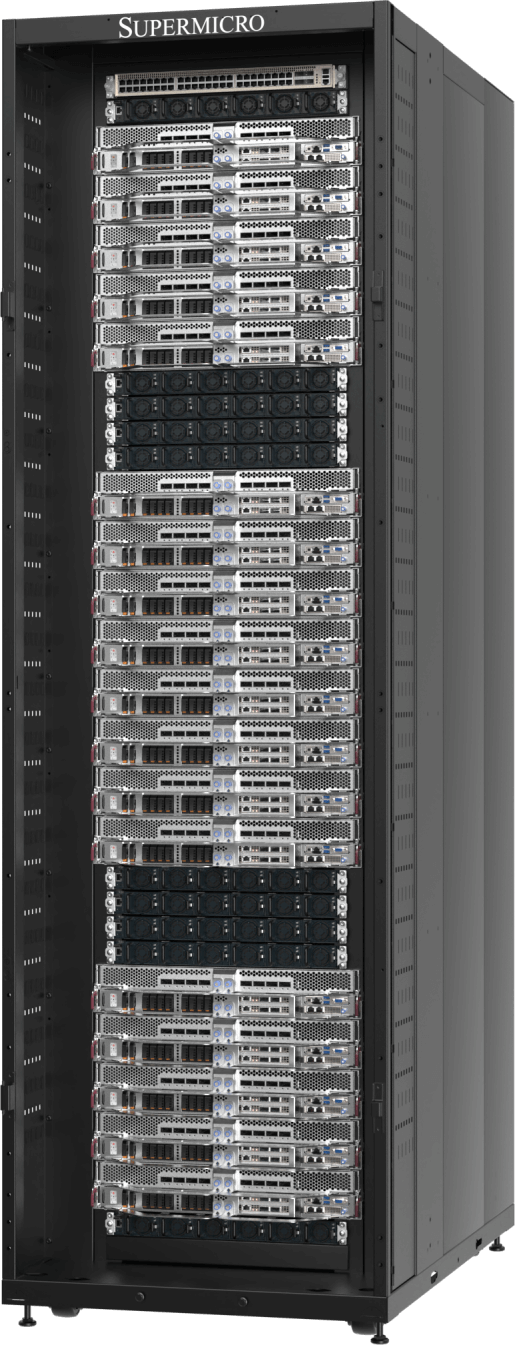

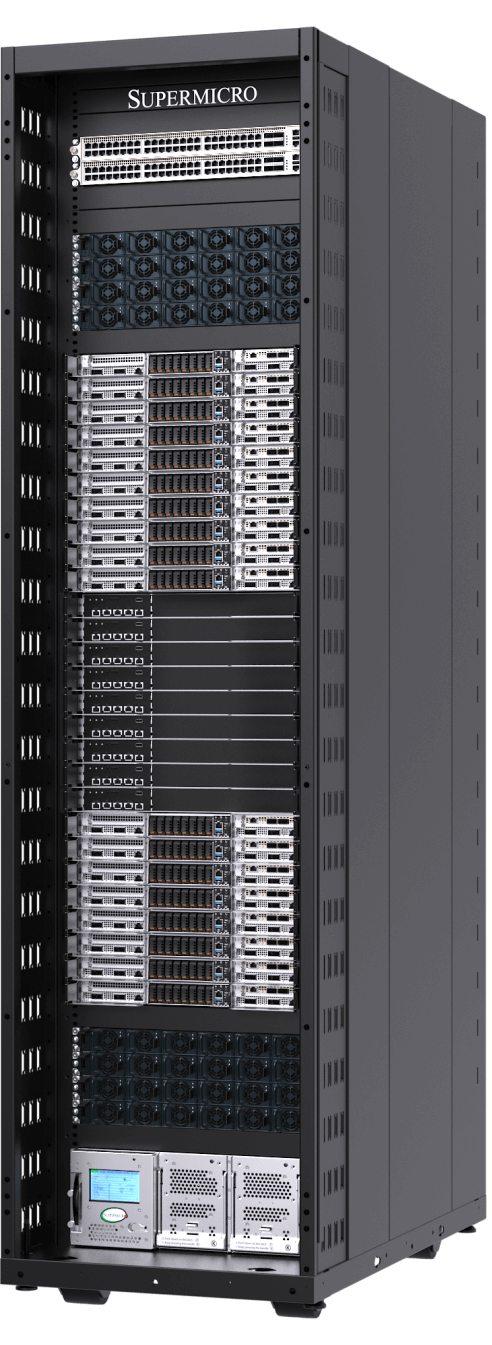

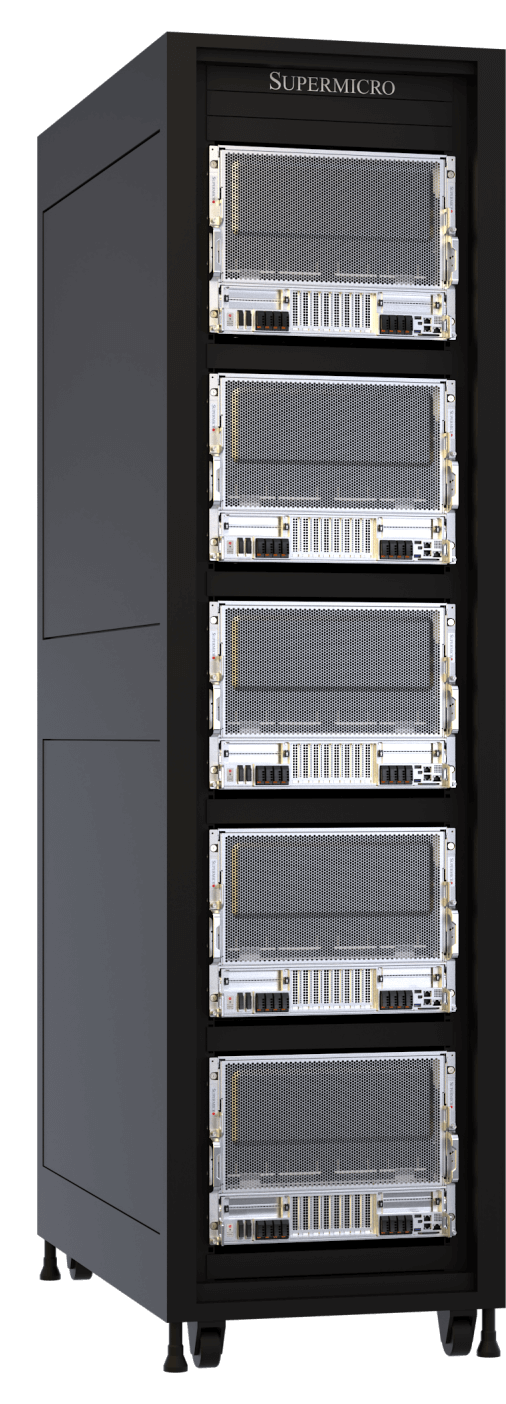

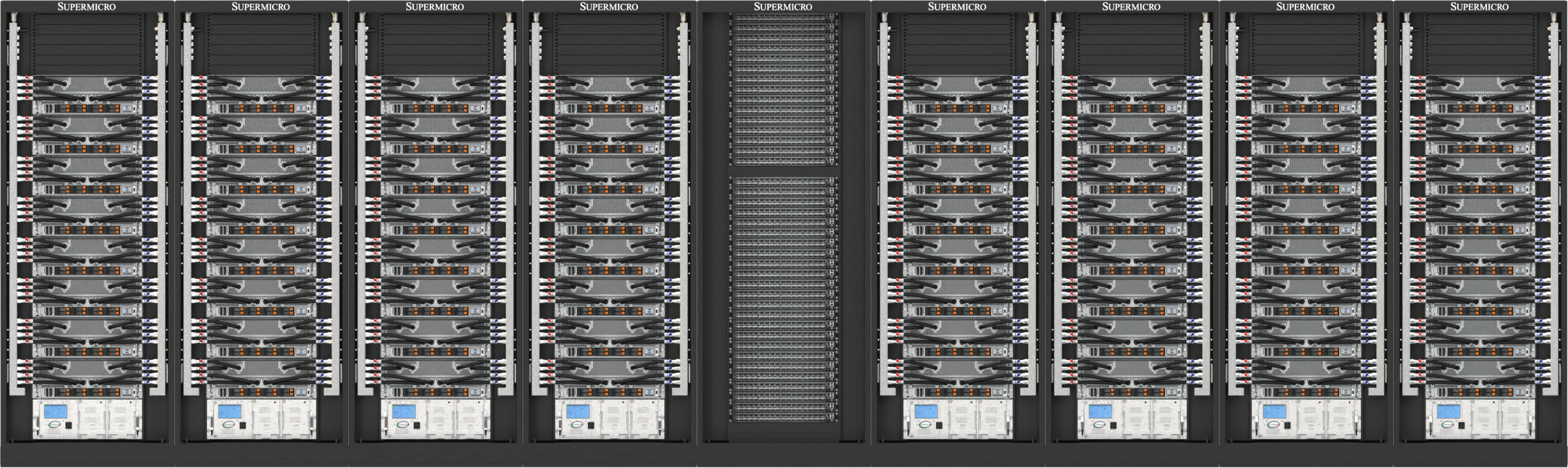

迅速な導入が可能なNVIDIA Blackwellプラグアンドプレイスケーラブルユニット

空冷または液冷データセンター用に42U、48U、または52Uのラック構成で利用できる新しいSuperClusterは、ラック内中段にNVIDIA Quantum InfiniBandまたはNVIDIA Spectrum™ネットワーキングを組み込んでおり、液冷SuperClusterは、42U/48Uの5ラックで、ノンブロッキングの256GPUのスケーラブルユニット を提供し、最先端のAIデータセンター展開向けに52Uの9ラックで、拡張768GPUのスケーラブルユニットを提供します。Supermicroはまた、大規模展開向けのインローCDUオプションや、設備用水を必要としないLiquid-to-Airのラックソリューションも提供しています。空冷SuperClusterの設計は、実績のある前世代のアーキテクチャを継承し、48Uの9ラックで256GPUのスケーラブルユニットを提供します。

NVIDIA Blackwellのためのエンドツーエンドのデータセンター・ビルディング・ブロック・ソリューションと展開サービス

Supermicroは、グローバルな製造拠点を持つ包括的なワンストップ・ソリューションプロバイダーとして、データセンターレベルのソリューション設計、液冷技術、スイッチング、ケーブル配線、データセンター管理ソフトウェア一式、L11およびL12ソリューションの検証、現場での設置、専門的なサポートとサービスを提供します。サンノゼ、ヨーロッパ、アジアに製造拠点を持つSupermicroは、液冷または空冷ラックシステムの圧倒的な製造能力を提供し、タイムリーな納品、総所有コスト(TCO)の削減、一貫した品質を保証します。

NVIDIA Quantum InfiniBandまたはNVIDIA Spectrum™ネットワーキングでラック内中段に最適化配置されたSupermicroのNVIDIA Blackwellソリューションは、最高のインフラストラクチャのスケーリングとGPUクラスタリングを実現し、5ラックでノンブロッキングの256GPUスケーラブルユニット、または9ラックで拡張768GPUスケーラブルユニットを提供します。NVIDIA Enterpriseソフトウェアをネイティブにサポートするこのアーキテクチャは、Supermicroの液冷技術と共に世界最大のAIデータセンターに優れた効率性を提供し、展開までの期間を短縮します。

NVIDIA QuantumInfiniBand Spectrumイーサネット

主流のエンタープライズサーバーから高性能スーパーコンピュータまで、NVIDIA Quantum InfiniBandおよびSpectrum™ネットワーキング技術は、最もスケーラブルで高速かつ安全なエンドツーエンドネットワーキングを実現します。

NVIDIA SuperNICs

SupermicroはInfiniBand用のNVIDIA ConnectXとイーサネット用のNVIDIA BlueField-3 SuperNICを採用しています。SupermicroのNVIDIA HGX B200システムはすべて、超並列AIコンピューティングのためのNVIDIA GPUDirect® RDMA (InfiniBand)またはRoCE (イーサネット)を利用できるように、各GPUに1:1のネットワーキングを搭載しています。

NVIDIAAI Enterprise

NVIDIAアプリケーションフレームワーク、API、SDK、Toolkit、Optimizerへのフルアクセスに加え、AI Blueprint、NVIDIA NIM、RAG、最新の最適化されたAI基盤モデルを展開する機能なども提供されます。NVIDIA AI Enterprise Softwareは、エンタープライズ規模のセキュリティ、サポート、安定性を備えたプロダクショングレードのAIアプリケーションの開発と展開を合理化し、プロトタイプから本番へのスムーズな移行を実現します。