AIの時代において、コンピューティング能力はもはやサーバーの数だけで測られるものではありません。相互接続されたGPU、CPU、メモリー、ストレージ、そしてラック内の複数のノードにまたがるこれらのリソースが、今日の人工知能を構成しています。 このインフラストラクチャには、高速かつ低遅延のネットワークファブリックに加え、各データセンター環境で最適なパフォーマンスと効率を維持するための、綿密に設計された冷却技術と電力供給が求められます。Supermicro、急速に進化する生成AI 大規模言語モデル(LLM)向けに、エンドツーエンドのAIデータセンターソリューションを提供します。

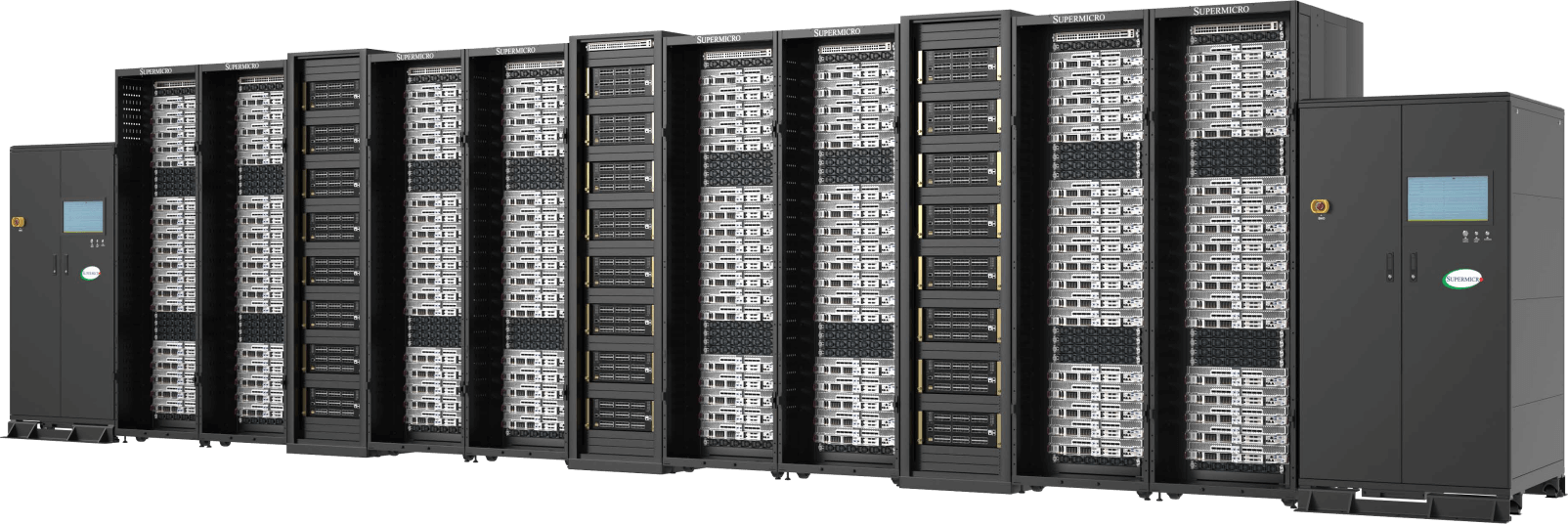

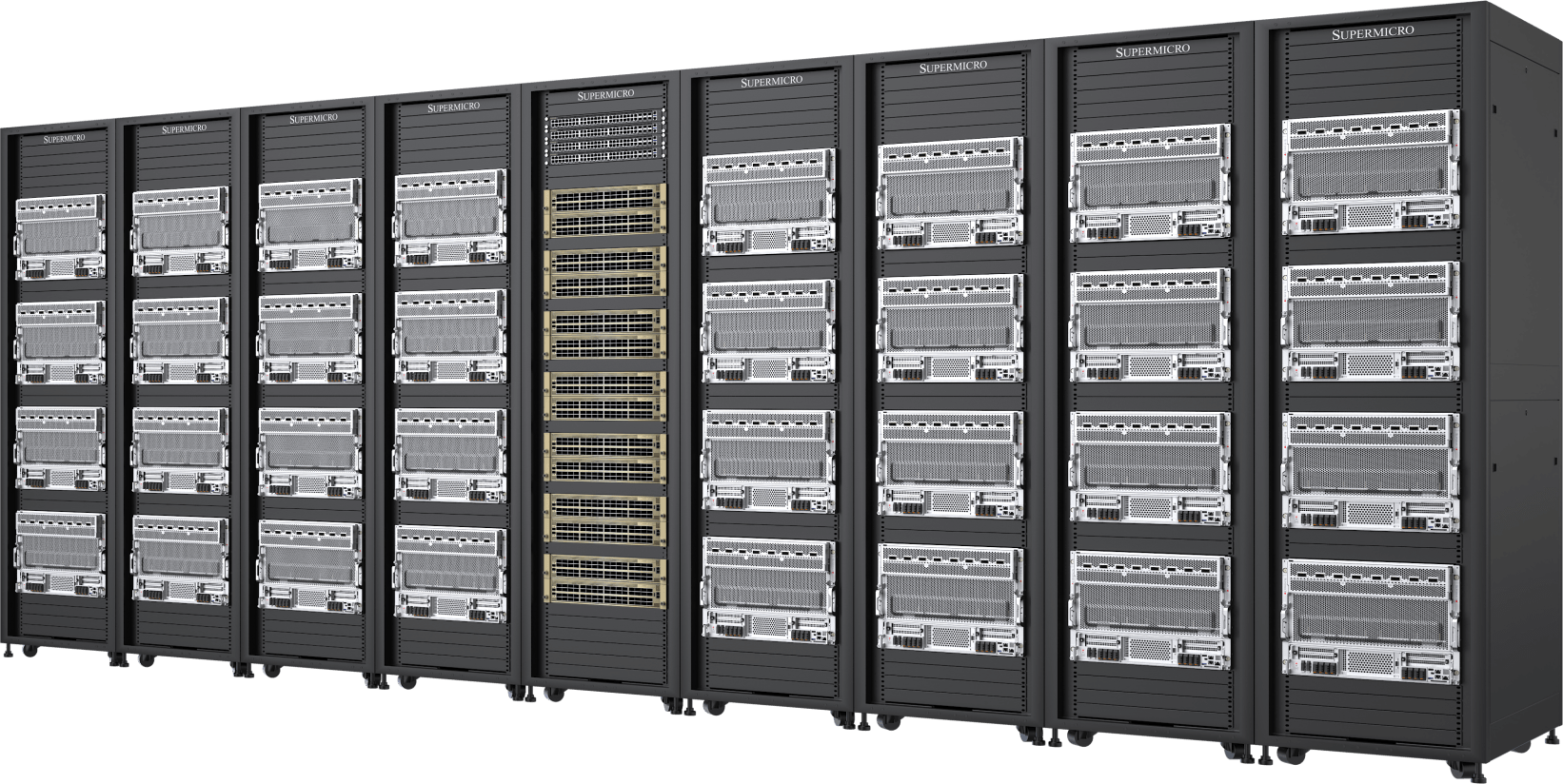

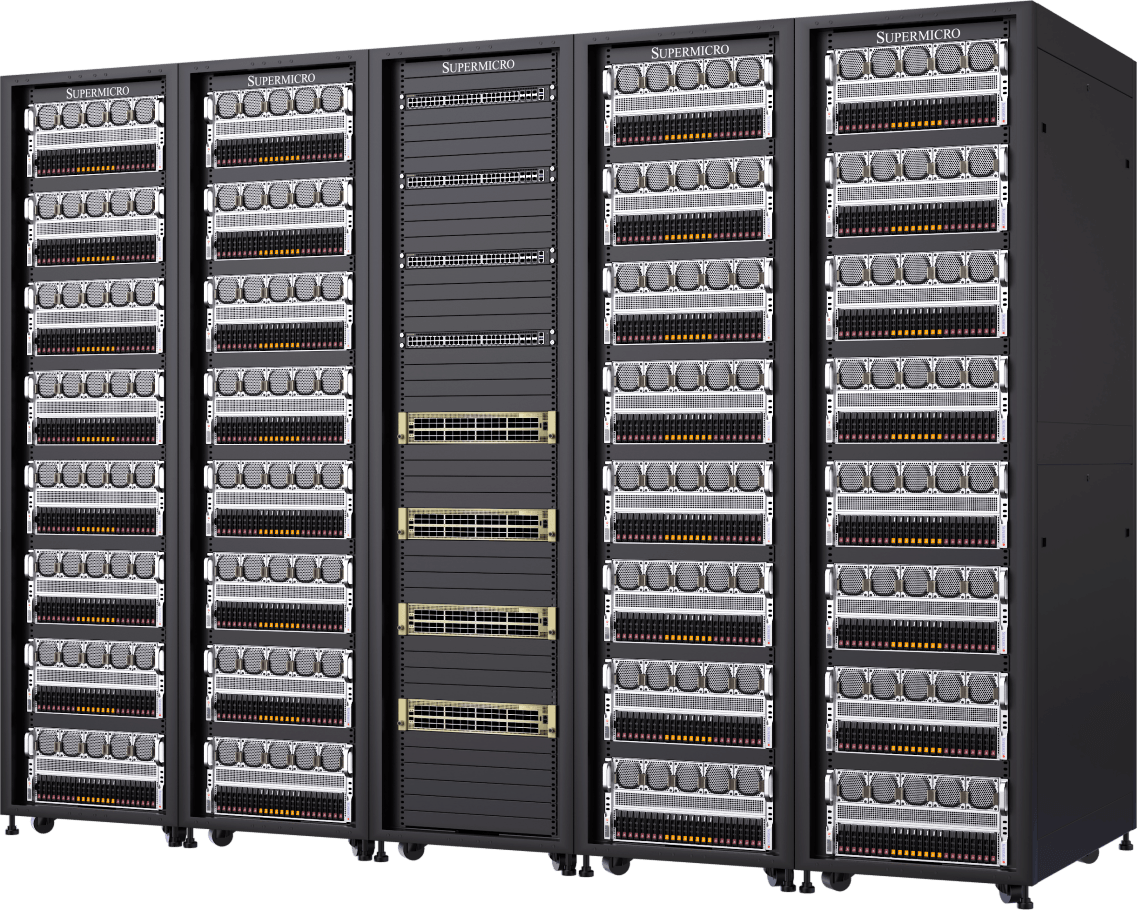

規模に応じた完全な統合

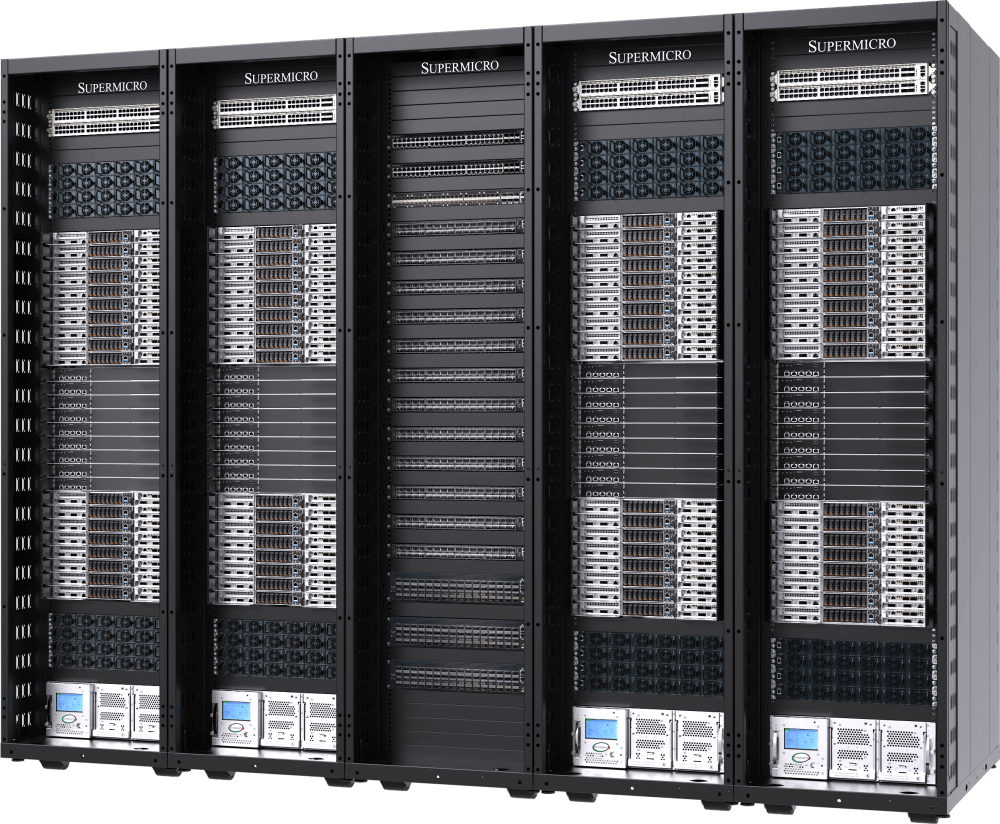

フルラックおよびクラスタの設計・製造。 5,000 ラック 月あたり

オンサイトサービスによるテスト、検証、デプロイ

実証済みのL11、L12試験プロセスにより、出荷前に運用の有効性と効率を徹底的に検証します。

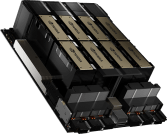

液冷/空冷

GPUおよびCPU用コールドプレート、冷却分配ユニット、マニホールドを備えた、完全統合型の水冷または空冷ソリューション

供給と在庫管理

ワンストップ・ショップにより、完全一体型ラックを迅速かつオンタイムで提供し、ソリューション導入までの時間を短縮します。

このフルターンキー・データセンター・ソリューションは、ミッションクリティカルな企業ユースケースの納期を短縮し、従来はスーパーコンピューティングの集中的な設計チューニングと時間のかかる最適化によってのみ達成可能であった大規模クラスタ構築の複雑さを解消します。

水冷式2UNVIDIA HGX B300AIクラスター

完全統合型の水冷式144ノードクラスターで、最大1152基のNVIDIA B300 GPUを搭載しております。

- コンパクトな2-OU水冷システムノードを搭載したNVIDIA HGX B300による、比類のないトレーニング 密度

- Supermicro 液体冷却システム(1.8MW容量のインロー型CDUを搭載、インラックCDU )

- ファウンデーショントレーニングに向けた、メモリー のHBM3eメモリー (メモリー )およびメモリー

- NVIDIAQuantum-X800 InfiniBand によるスケールアウトInfiniBand ultra・高帯域幅InfiniBand AI ファブリックInfiniBand

- NVIDIA GPUDirect RDMA および Storage または RoCE を完全にサポートする専用ストレージファブリックオプション

- NVIDIAAI Enterprise NVIDIA Run:ai を含む NVIDIAAI Enterprise ソフトウェアプラットフォームを完全にサポートするように設計されています

計算ノード

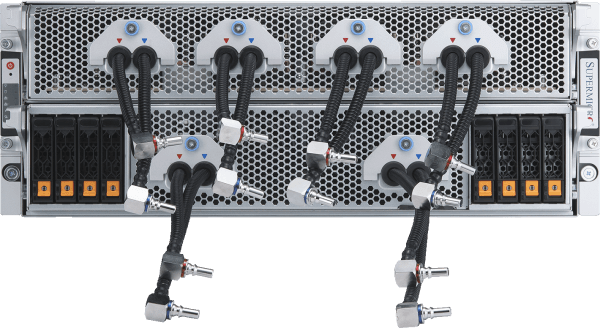

液体冷却式4U NVIDIA HGX B300AIクラスター

完全統合型の液体冷却72ノードクラスターで、最大576基のNVIDIA B300 GPUを搭載しております。

- 演算密度と保守性に最適化されたNVIDIA HGX推論 、ハイパフォーマンス トレーニング 推論 を展開しましょう

- Supermicro 液体冷却システムは、持続的な高出力動作とエネルギー効率の向上を目的として設計されています

- ファウンデーショントレーニングに向けた、メモリー のHBM3eメモリー (メモリー )およびメモリー

- NVIDIASpectrum™-X イーサネット NVIDIAQuantum-X800 InfiniBandによるスケールアウト

- NVIDIA GPUDirect RDMA および Storage または RoCE を完全にサポートする専用ストレージファブリックオプション

- NVIDIAAI Enterprise NVIDIA Run:ai を含む NVIDIAAI Enterprise ソフトウェアプラットフォームを完全にサポートするように設計されています

計算ノード

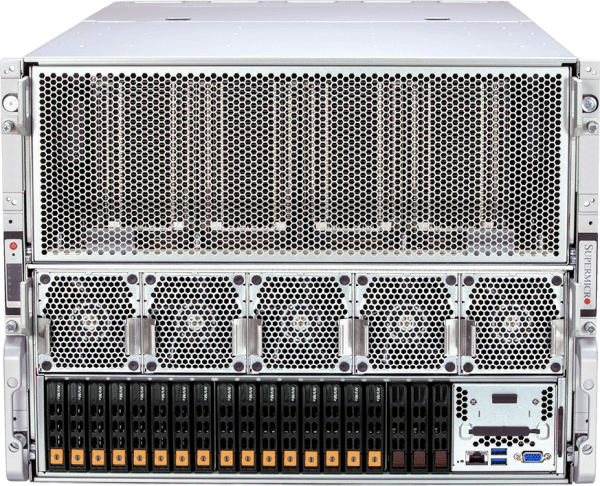

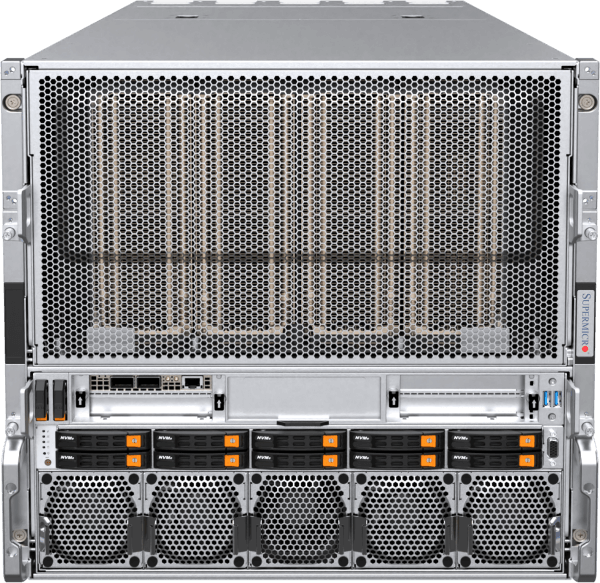

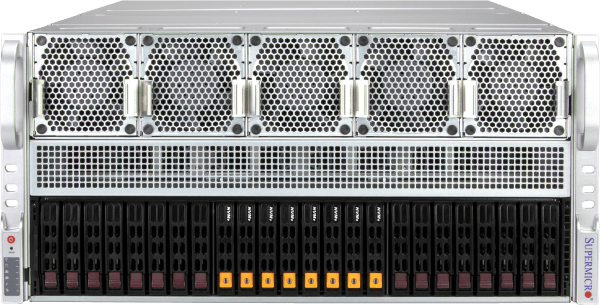

空冷式8U NVIDIA HGX B300AIクラスター

最大256基のNVIDIA HGX B300 GPUと合計73.7TBのHBM3eメモリーを搭載した、完全統合型の空冷式32ノードクラスター

- Supermicro 、NVIDIA GPU、NVIDIAソフトウェア、およびNVIDIAネットワークソリューションを含む、リファレンスアーキテクチャに基づくフルスタックソリューション

- 最大256基のNVIDIA HGX B300 GPUを搭載し、合計最大73.7メモリー HBM3eメモリー を提供しますメモリー GPUあたり288GBのHBM3e*)

- NVIDIAソフトウェアスタック(NVIDIAAI Enterprise NVIDIA Run:ai)との互換性

- ラックに完全に組み込まれ、出荷前および現場での設置前にテスト済みの、プラグアンドプレイ対応ソリューション

- NVIDIASpectrum-X イーサネット ・ファブリックまたは NVIDIA Quantum-X800InfiniBand によるスケールアウト。コンバージド・ネットワークおよびアウト・オブ・バンド管理機能が含まれています

- NVIDIAが推奨するSupermicro AI ファクトリー 、インフラストラクチャ構成、Spectrum-Xネットワーク、およびNVIDIA Enterprise Reference Architecture for HGX B300に基づくソフトウェアリファレンススタックに対応しています

計算ノード

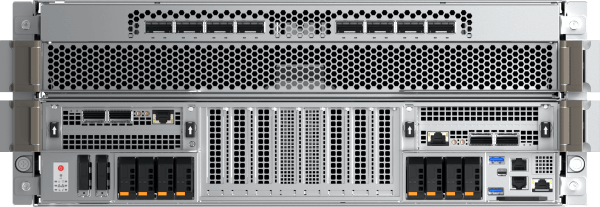

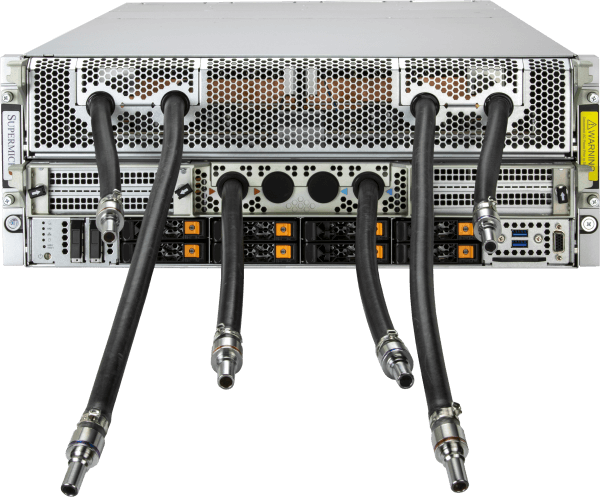

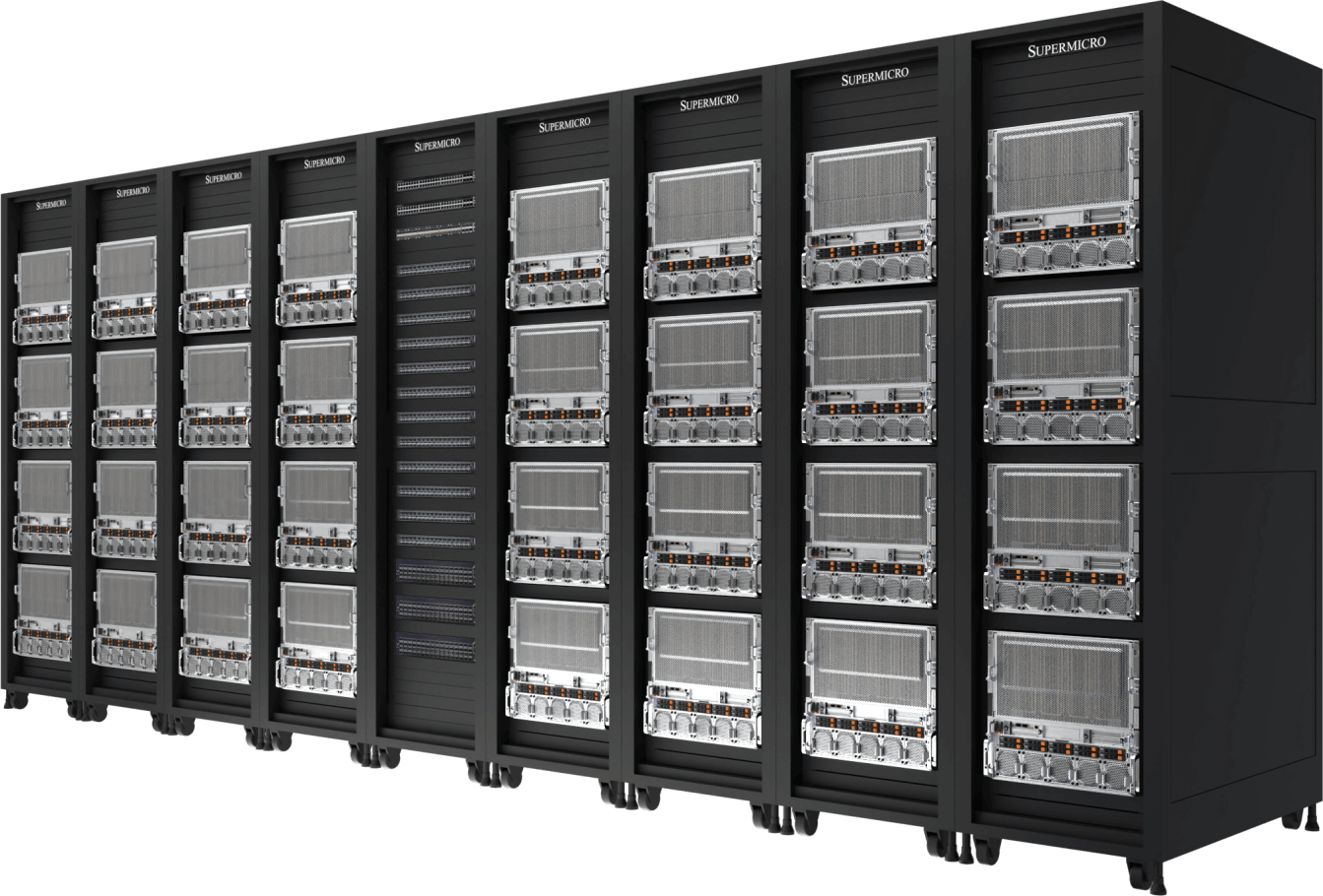

水冷式NVIDIA HGX B200AIクラスタ

5ラックで最大32個のNVIDIA HGX B200 8-GPU、4U液冷システム(256 GPU)を使用可能

- 1つのスケーラブルなユニット(5ラック)に256基のNVIDIA B200 GPUを搭載し、AIトレーニング 推論 の最高峰を実現します

- Supermicro 冷システム。250kWの容量を持つラック内冷却液分配ユニット(CDU)を搭載し、冗長化された電源ユニット(PSU)とデュアルホットスワップ対応ポンプを備えています。

- 1つのスケーラブルユニットメモリー 45 TBのHBM3eメモリー

- 400Gb/s NVIDIASpectrum-X イーサネット NVIDIA Quantum-2InfiniBandによるスケールアウト

- NVIDIA GPUDirect RDMA および Storage または RoCE を完全にサポートする専用ストレージファブリックオプション

- NVIDIAAI Enterprise NVIDIA Run:ai を含む NVIDIAAI Enterprise ソフトウェアプラットフォームを完全にサポートするように設計されています

計算ノード

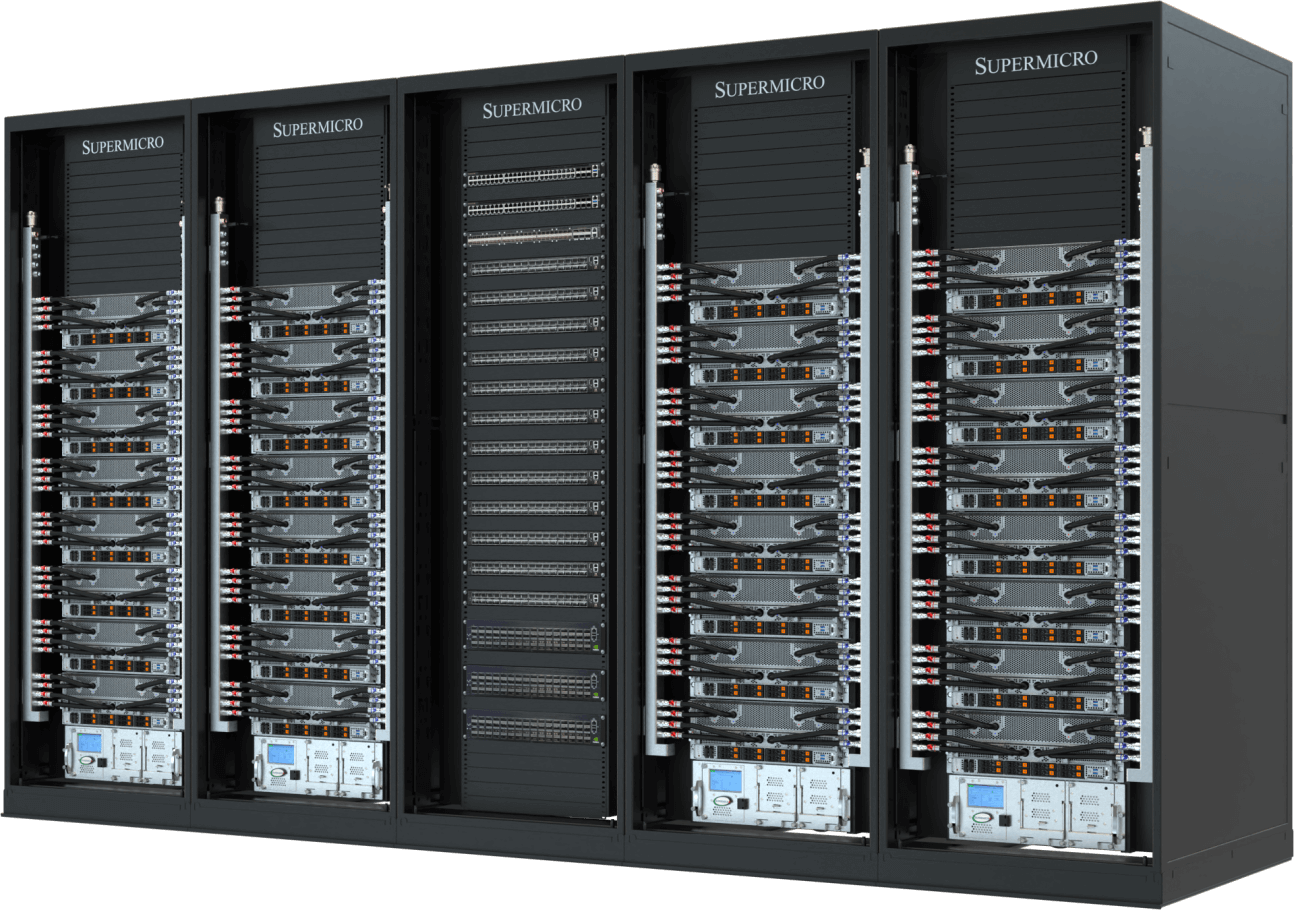

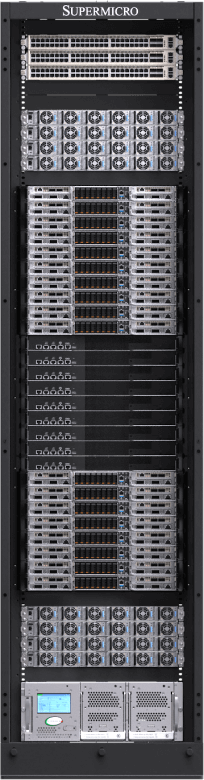

空冷NVIDIA HGX B200 AIクラスタ

32 NVIDIA HGX B200 8-GPU、10U空冷システム(256 GPU)を9ラックに搭載

- 熱的に最適化された新しい空冷システム・プラットフォームによる、業界をリードする実績あるアーキテクチャ

- 1つのスケーラブルユニットメモリー 45 TBのHBM3eメモリー

- 400Gb/s NVIDIASpectrum-X イーサネット NVIDIAQuantum-2 InfiniBandによるスケールアウト

- NVIDIA GPUDirect RDMA および Storage または RoCE を完全にサポートする専用ストレージファブリックオプション

- NVIDIA認定システムノードで、NVIDIAAI Enterprise NVIDIA Run:aiを含むNVIDIA AIソフトウェアプラットフォームを完全にサポートしています

計算ノード

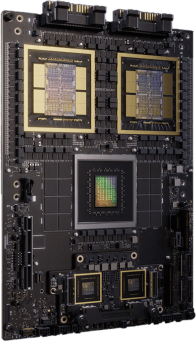

NVIDIA GB300NVL72

1台のラックで液冷エクサスケール・コンピューティングを実現

- NVIDIA GB300 Grace™Blackwell を搭載したラックスケールソリューションで、1ラックあたり72基のNVIDIA B300 GPUとGrace を提供します

- Ultra VIDIABlackwell Ultra

- データセンターの電力コストを最大40%削減する直接水冷方式

- ご相談から本格的な導入まで、必要な部品、ネットワークソリューション、および現地設置サービスを一括してご提供いたします

- 400Gb/s NVIDIASpectrum-X イーサネット NVIDIAQuantum-2 InfiniBandによるスケールアウト

- 最大800Gb/sのNVIDIA Quantum-2InfiniBand Spectrum イーサネット X イーサネット NVIDIA ConnectX®-8 SuperNICイーサネット

ラックソリューション

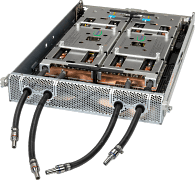

NVIDIA GB200NVL72

1台のラックで液冷エクサスケール・コンピューティングを実現

- 72基のNVIDIABlackwell GPUが、1つのGPUとして動作し、膨大なHBM3eメモリー ラックあたり13.5TB)を備えています

- 9基のNVLinkスイッチを搭載し、各コンピュートトレイに4ポートを配置して72基のGPUを接続し、1.8TB/sのGPU間インターコネクトを実現します

- Supermicro 冷システム。250kWの容量を持つラック内冷却液分配ユニット(CDU)を搭載し、冗長化された電源ユニット(PSU)とデュアルホットスワップ対応ポンプを備えています。

- NVIDIA GPUDirect RDMA および Storage または RoCE を完全にサポートする専用ストレージファブリックオプション

- 400Gb/s NVIDIASpectrum-X イーサネット NVIDIAQuantum-2 InfiniBandによるスケールアウト

- NVIDIAAI Enterprise NVIDIA Run:ai を含む NVIDIAAI Enterprise ソフトウェアプラットフォームを完全にサポートするように設計されています

ラックソリューション

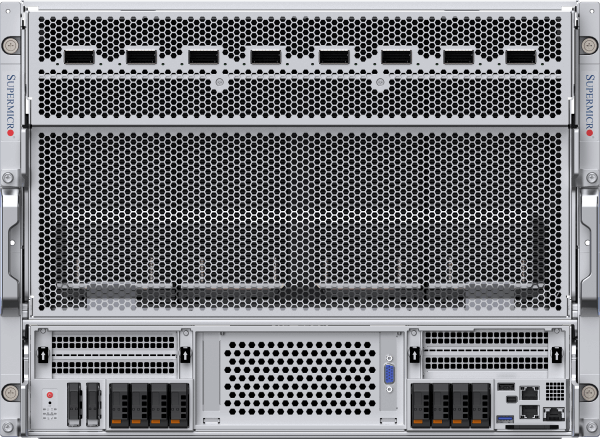

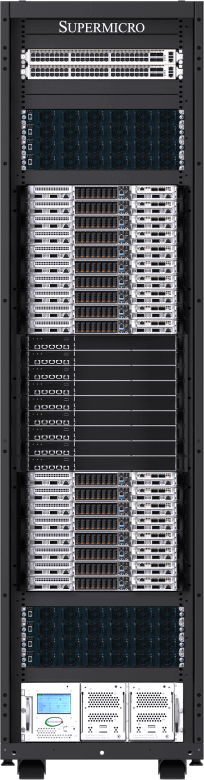

NVIDIARTX スーパークラスター

NVIDIARTX 6000Blackwell Edition 搭載のAI ファクトリー

- Supermicro 、NVIDIA GPU、NVIDIAソフトウェア、およびNVIDIAネットワークソリューションを含む、リファレンスアーキテクチャに基づくフルスタックソリューション

- 最大256基のNVIDIARTX 6000Blackwell Edition GPUを搭載し、最大24TBのGDDR7メモリーを提供します

- NVIDIAソフトウェアスタック(NVIDIAAI Enterprise、NVIDIAOmniverse、およびNVIDIA Run:ai)との互換性

- ラックに完全に組み込まれ、出荷前および現場での設置前にテスト済みの、プラグアンドプレイ対応ソリューション

- NVIDIASpectrum-X イーサネット 、コンバージド・ネットワーク、およびアウト・オブ・バンド管理機能が含まれています

- NVIDIAが推奨するSupermicro AI ファクトリー 、インフラストラクチャ構成、Spectrum-Xネットワーク、およびNVIDIA Enterprise Reference Architecture forRTX 6000Blackwell Editionに基づくソフトウェアリファレンススタックに対応しています

計算ノード

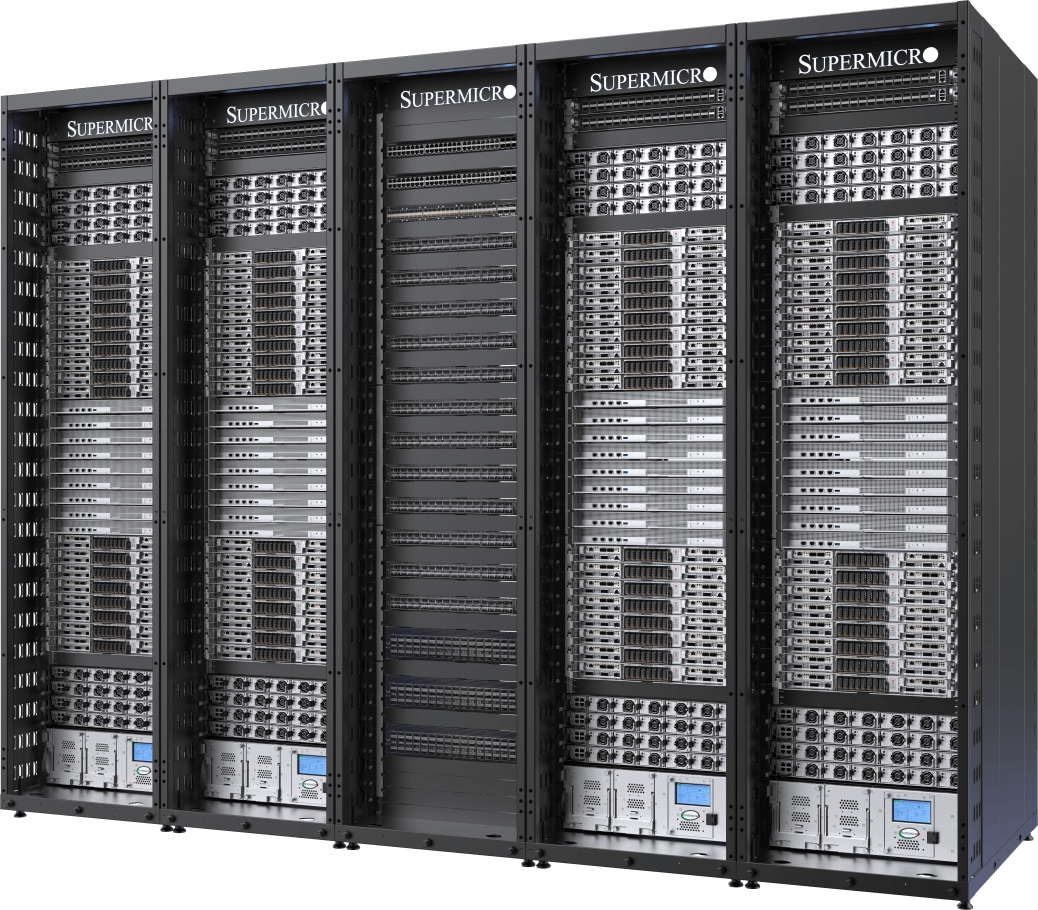

業界をリードする液冷AIクラスタ

5つのラックに、NVIDIA HGX H200 8-GPU搭載の4U水冷システムを32台(計256 GPU)配置

- Supermicroカスタム水冷ソリューションにより、データセンターの演算密度を2倍に高め、電力コストを最大40%削減

- 1つのスケーラブルなユニットに256基のNVIDIA H200 GPUを搭載

- 1つのスケーラブルなユニットに、H200を搭載した36TBのHBM3e

- NVIDIA GPUDirect RDMA および Storage または RoCE を完全にサポートする専用ストレージファブリックオプション

- 400Gb/s NVIDIASpectrum-X イーサネット NVIDIAQuantum-2 InfiniBandによるスケールアウト

- NVIDIA認定システムノードで、NVIDIAAI Enterprise NVIDIA Run:aiを含むNVIDIA AIソフトウェアプラットフォームを完全にサポートしています

計算ノード

実績あるデザイン

9つのラックに、NVIDIA HGX H200 8-GPU搭載の8U空冷システムを32台(計256基のGPU)配置

- 大規模なAIインフラ展開のための業界をリードする実績あるアーキテクチャ

- 1つのスケーラブルなユニットに256基のNVIDIA H200 GPUを搭載

- 1つのスケーラブルなユニットに、H200を搭載した36TBのHBM3e

- 400Gb/s NVIDIASpectrum-X イーサネット NVIDIAQuantum-2 InfiniBandによるスケールアウト

- 業界をリードする並列ファイルシステムオプションを備えたカスタマイズ可能なAIデータパイプラインストレージファブリック

- NVIDIA認定システムノードで、NVIDIAAI Enterprise NVIDIA Run:aiを含むNVIDIA AIソフトウェアプラットフォームを完全にサポートしています

計算ノード