「Supermicroのサーバーポートフォリオの奥深さは、Lambdaにとっての資産です。当社がトレーニングと推論のためのギガワット規模のAIファクトリーを構築し、世界で最もAI先進的な組織向けにプロダクショングレードのAIクラウドを展開し、お客様向けに無限スケールのオンデマンドコンピューティングを創造するよう努める中で、現在および将来のニーズを満たす強力なGPU最適化サーバーの選択肢を持つパートナーに頼ることができると確信しています。」

課題

- ラムダは、技術的な発展や、より高速なパフォーマンスを求める顧客ニーズの高まりに対応するため、最新のNVIDIA GPUを搭載した最新のサーバーを導入する必要がありました。

- ラムダは幅広いユーザーにサービスを提供しています。こうした需要の高まりに伴い、Lambdaはパフォーマンスや効率を犠牲にすることなくスケーラビリティを確保したいと考えていました。

- ラムダは、高性能なサーバーとともに、顧客のニーズを満たす革新的なソフトウェアを開発する必要がありました。

- 顧客が迅速に導入し、最小限のセットアップ時間でAIワークロードに必要な環境を構築できるようにしたいと考えていました。

ソリューション

- Lambda は、継続的な顧客需要に応えるため、Supermicro の GPU 最適化サーバーを選択しました。

- Lambda は、顧客の増大する需要に応えるため、Intel CPU と NVIDIA Blackwell GPU を搭載した Supermicro システムの組み合わせを選択しました。

- Lambda は、持続可能性を伴うスケーラビリティを確保するため、Supermicro の液冷ソリューションを採用しました。

- Supermicroのモジュール式ビルディングブロックアーキテクチャは、迅速な展開を可能にし、市場投入までの時間を短縮しました。

- 会社概要

- ラムダ

- 産業

- クラウドサービスプロバイダー

- 所在地

- アメリカ

主な結果

高度な冷却による効率の向上

この新しいサーバーは、大規模なAIワークロードを処理する場合でもエネルギー効率を維持できるよう、液冷を採用しています。

スケーラビリティのサポート

Supermicro独自のアーキテクチャを活用することで、Lambdaはユースケースに応じてスケールアップまたはスケールダウンする能力を有しています。

GPUパワーに簡単かつ即座にアクセス

1-Click-Clustersを使用すると、ユーザーは強力なGPUクラスタにわずか数分で、これまでよりもはるかに高速にアクセスできます。

AIの未来への準備

最新のGPUと高度なネットワークにより、ラムダは将来のAIモデルとテクノロジーをサポートするように構築されています。

Lambda は、顧客に大幅な性能向上を提供するため、Supermicro の様々な GPU 最適化サーバーを選択

NVIDIA Blackwell GPUを搭載したサーバーがさまざまなアプリケーションを加速

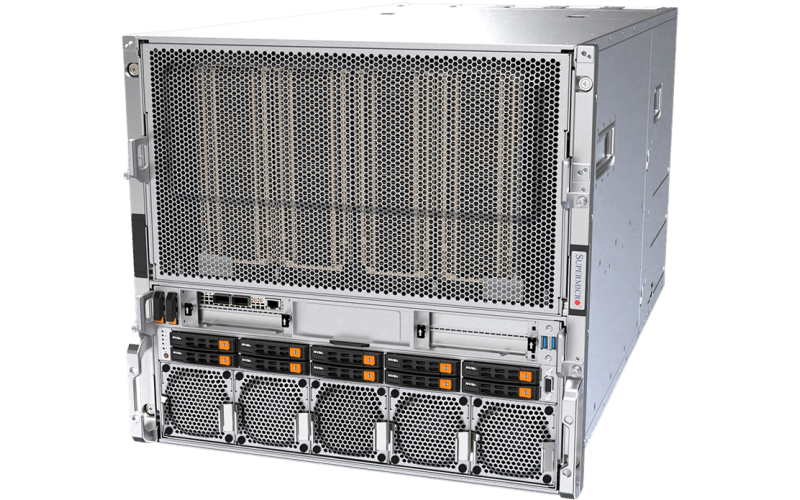

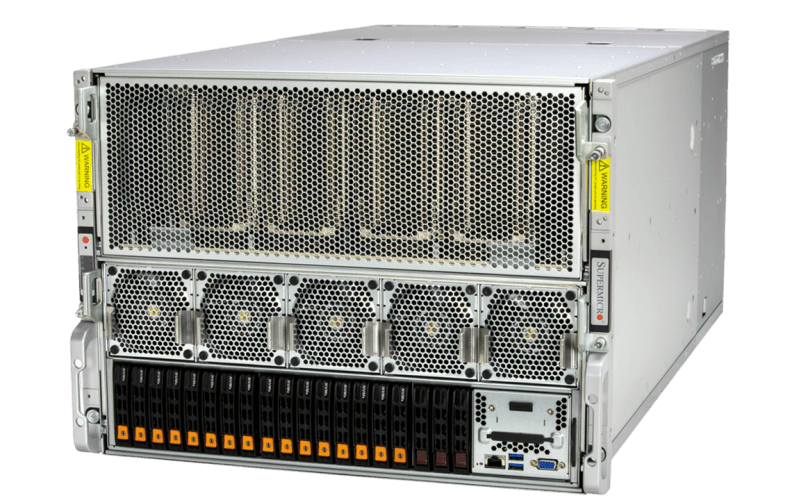

Supermicroソリューションと主要システム

ラムダはインフラの一部として以下のサーバーを選択しました: